- От Хаоса к Шедеврам: Как Сэмплинг и Шум Творят Магию в Генеративных Моделях

- Что такое Генеративные Модели и Почему Они Важны?

- Ключевые Типы Генеративных Моделей

- Загадка Шума: Больше, Чем Просто Случайность

- Формы и Цели Шума

- Сэмплинг: Искусство Манифестации

- Различные Стратегии Сэмплинга

- Шум и Сэмплинг в Действии: Глубокое Погружение в Архитектуры

- Генеративно-Состязательные Сети (GANs)

- Вариационные Автокодировщики (VAEs)

- Диффузионные Модели: Новая Граница

- Симбиотические Отношения: Почему Они Не Могут Жить Друг Без Друга

- Вызовы и Будущие Направления

- Поиск Контролируемости

- Оптимизация Стратегий Сэмплинга

От Хаоса к Шедеврам: Как Сэмплинг и Шум Творят Магию в Генеративных Моделях

Привет, друзья-энтузиасты технологий и любопытные умы! Сегодня мы погрузимся в одну из самых захватывающих и, на первый взгляд, парадоксальных областей современного искусственного интеллекта – мир генеративных моделей․ Это те самые нейронные сети, которые способны создавать реалистичные изображения, писать тексты, сочинять музыку и даже разрабатывать новые молекулы․ Нас часто поражает, как из ничего, казалось бы, рождаются столь сложные и осмысленные структуры․ Но за этой магией стоят два фундаментальных и неразрывно связанных процесса, которые мы часто недооцениваем: шум и сэмплинг․ Именно они являются тайными ингредиентами, превращающими хаос в упорядоченное искусство, а абстрактные идеи — в конкретные воплощения․

Мы привыкли думать о шуме как о чем-то нежелательном, помехе, которую нужно устранить․ Однако в контексте генеративных моделей шум — это не просто случайность; это источник креативности, искра, из которой разгорается пламя творения․ Он дает моделям свободу исследовать бескрайние просторы возможных данных, избегая повторений и шаблонности․ Сэмплинг же, это процесс превращения этой абстрактной, "шумной" идеи в осязаемый результат, извлечение конкретного примера из бесконечного множества вариантов, которые модель потенциально может сгенерировать․ Вместе они формируют сердце генеративного ИИ, позволяя ему не просто воспроизводить, но и по-настоящему творить․ Давайте разберемся, как эти два, казалось бы, простых понятия становятся краеугольными камнями в архитектуре самых продвинутых систем искусственного интеллекта․

Что такое Генеративные Модели и Почему Они Важны?

Прежде чем углубляться в нюансы шума и сэмплинга, давайте коротко освежим в памяти, что такое генеративные модели․ В широком смысле, это класс алгоритмов машинного обучения, разработанных для изучения распределения данных и последующей генерации новых данных, которые соответствуют этому распределению․ Если дискриминативные модели учатся классифицировать или предсказывать метки для существующих данных (например, определить, кошка на картинке или собака), то генеративные модели идут дальше: они учатся создавать что-то совершенно новое, что выглядит и ощущается как "настоящее", хотя и не существовало в обучающем наборе․

Мы видим их повсюду: от создания фотореалистичных лиц людей, которых никогда не существовало, до генерации связных и осмысленных текстов, способных имитировать человеческий стиль․ Эти модели лежат в основе многих передовых приложений, таких как глубокие фейки, генерация контента для метавселенных, синтез речи, разработка лекарств и даже создание новых произведений искусства․ Их способность к творчеству и инновациям открывает двери для совершенно новых парадигм взаимодействия с технологиями и расширяет границы того, что мы считали возможным для машин․

Важность генеративных моделей трудно переоценить․ Они не только позволяют автоматизировать создание контента и персонализировать пользовательский опыт, но и служат мощным инструментом для научных исследований․ Мы можем использовать их для симуляции сложных систем, аугментации данных для обучения других моделей, изучения скрытых зависимостей в больших массивах информации․ Понимание того, как они работают, становится ключом к освоению будущего ИИ, и именно здесь роль шума и сэмплинга выходит на передний план․

Ключевые Типы Генеративных Моделей

В мире генеративных моделей существует несколько архитектур, каждая со своими уникальными особенностями и подходами к генерации данных․ Мы сосредоточимся на тех, где шум и сэмплинг играют наиболее заметную роль:

- Генеративно-состязательные сети (GANs): Это одна из самых известных архитектур, состоящая из двух нейронных сетей – генератора и дискриминатора, которые соревнуются друг с другом․ Генератор пытается создать реалистичные данные из случайного шума, а дискриминатор пытается отличить "настоящие" данные от сгенерированных․

- Вариационные автокодировщики (VAEs): Эти модели учатся сжимать данные в латентное пространство (скрытое представление) и затем восстанавливать их․ Они используют вероятностный подход, что делает их особенно интересными для нашего обсуждения․

- Диффузионные модели (Diffusion Models): Относительно новый, но чрезвычайно мощный класс моделей, которые постепенно добавляют шум к данным, а затем учатся инвертировать этот процесс, постепенно удаляя шум, чтобы создать новые данные․

Понимание работы этих моделей позволит нам глубже оценить, как именно шум и сэмплинг участвуют в процессе их функционирования и что делает их такими эффективными․

Загадка Шума: Больше, Чем Просто Случайность

Для большинства из нас "шум" ассоциируется с чем-то негативным: помехи на радио, зернистость на фотографии, нежелательные звуки․ Но в генеративных моделях шум играет совершенно иную, конструктивную роль․ Мы можем рассматривать его не как дефект, а как сырье для творчества, как некую "первичную материю", из которой модель начинает лепить свои творения․ Это своего рода случайный входной вектор, который подается в генератор и служит отправной точкой для процесса генерации․

Основная функция шума заключается в обеспечении разнообразия․ Если бы генератор всегда получал один и тот же вход, он бы всегда производил один и тот же выход, что совершенно бесполезно для создания новых, уникальных образцов․ Шум позволяет модели исследовать различные части своего "пространства возможностей", генерируя каждый раз что-то немного (или значительно) отличающееся․ Это делает каждую генерацию уникальной, как снежинка или отпечаток пальца․ Без шума генеративные модели были бы просто сложными копировальными аппаратами, а не творческими сущностями․

Давайте посмотрим на это с другой стороны․ Представьте художника, который каждый раз начинает рисовать картину с чистого холста․ Шум в этом контексте — это как случайный набор начальных мазков или цветовых пятен, которые дают художнику отправную точку и вдохновение для создания чего-то нового․ Каждый раз эти начальные мазки разные, что приводит к созданию уникальных произведений․ Именно эта случайность позволяет моделям не зацикливаться на одном "идеальном" образце, а создавать целый спектр правдоподобных, но разнообразных примеров․

Формы и Цели Шума

Шум в генеративных моделях может принимать различные формы, но чаще всего мы имеем дело с:

- Гауссовский шум (нормальное распределение): Это наиболее распространенный тип, где значения случайны и следуют колоколообразной кривой․ Он часто используется из-за своих математических свойств и простоты генерации․

- Равномерный шум: В этом случае все значения в заданном диапазоне имеют одинаковую вероятность․

Независимо от конкретного распределения, шум служит нескольким ключевым целям:

- Исследование латентного пространства: Шум подается в так называемое "латентное пространство" (скрытое представление), которое генератор затем преобразует в данные․ Различные точки в этом латентном пространстве соответствуют различным характеристикам генерируемых данных․ Шум помогает модели "путешествовать" по этому пространству․

- Предотвращение коллапса мод (Mode Collapse): В GANs, например, генератор может начать генерировать очень ограниченный набор высококачественных образцов, игнорируя остальное разнообразие обучающих данных․ Это называется коллапсом мод․ Шум, подаваемый на вход, стимулирует генератор исследовать более широкий спектр выходов и избегать этой проблемы․

- Улучшение робастности: Добавление контролируемого шума во время обучения может сделать модели более устойчивыми к небольшим изменениям во входных данных․

Таким образом, шум — это не просто случайный элемент, а тщательно продуманный компонент, который обеспечивает гибкость, креативность и стабильность генеративных моделей․ Мы учимся не просто терпеть шум, а активно использовать его как мощный инструмент․

Сэмплинг: Искусство Манифестации

Если шум — это семена креативности, то сэмплинг — это процесс проращивания этих семян в осязаемые плоды․ Сэмплинг, или выборка, в контексте генеративных моделей означает извлечение конкретных образцов данных из распределения, которое модель выучила или построила․ Модель не просто "знает", как выглядят данные; она "знает" вероятностное распределение этих данных․ Сэмплинг позволяет нам получить один или несколько конкретных экземпляров из этого распределения․

Для нас, как пользователей, сэмплинг — это финальный шаг, когда мы получаем готовый результат: сгенерированное изображение, отрывок текста, новую мелодию․ Но внутри модели это сложный процесс, который тесно связан с шумом․ Модель принимает шум (случайный вектор) в качестве входных данных, интерпретирует его в своем латентном пространстве, а затем с помощью своих внутренних слоев нейронов преобразует этот абстрактный вход в структурированный и осмысленный выход, который мы видим․ Это процесс, когда "потенциал" (заложенный в шуме и выученном распределении) превращается в "реальность"․

Почему сэмплинг так важен? Он обеспечивает контроль и интерпретируемость․ Без возможности сэмплирования, модель была бы просто теоретическим конструктом, способным "понимать" данные, но не способным их производить․ Сэмплинг дает нам возможность:

- Проверять качество генерации: Мы можем оценить, насколько реалистичны и разнообразны сгенерированные образцы․

- Использовать модель для практических задач: Будь то создание нового контента или симуляция данных․

- Исследовать латентное пространство: Варьируя входной шум (или латентный вектор), мы можем наблюдать, как меняется выход, что позволяет нам понимать, какие характеристики данных кодируются в различных частях латентного пространства․

Таким образом, сэмплинг — это мост между абстрактным знанием модели и конкретным, воспринимаемым нами результатом․

Различные Стратегии Сэмплинга

В зависимости от архитектуры модели и желаемого результата, мы используем различные стратегии сэмплинга․ Некоторые из них относительно просты, другие, весьма изощренны:

- Прямой сэмплинг: В простейшем случае, как в GANs, мы просто подаем случайный шум на вход генератора и получаем на выходе сгенерированный образец․

- Сэмплинг из латентного пространства: В VAEs мы сначала сэмплируем точку из латентного распределения (которое само является результатом кодирования входных данных), а затем подаем эту точку на декодер для генерации выходных данных․

- Итеративный сэмплинг: В диффузионных моделях процесс сэмплирования является итеративным․ Мы начинаем с чистого шума и постепенно, шаг за шагом, удаляем шум, пока не получим четкое изображение․ Каждый шаг, это по сути "сэмплирование" из условного распределения․

- Условный сэмплинг: Часто мы хотим генерировать не просто случайные данные, а данные с определенными характеристиками (например, "лицо мужчины с усами" или "текст о космосе")․ В этом случае мы подаем дополнительную информацию (условие) вместе с шумом, направляя процесс генерации․

Каждая стратегия имеет свои преимущества и недостатки, и выбор зависит от конкретной задачи и требований к качеству и контролируемости генерируемых данных․ Главное, что мы всегда помним: без сэмплинга знание модели о распределении данных осталось бы нереализованным потенциалом․

Шум и Сэмплинг в Действии: Глубокое Погружение в Архитектуры

Чтобы по-настоящему понять, как шум и сэмплинг работают вместе, давайте рассмотрим их роль в различных типах генеративных моделей․ Мы увидим, как эти фундаментальные концепции проявляются в разных архитектурах, каждая из которых имеет свой уникальный подход к использованию случайности и ее материализации․

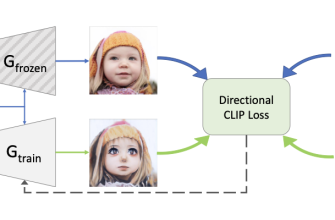

Генеративно-Состязательные Сети (GANs)

В GANs шум является ключевым входным параметром для генератора․ Генератор берет на вход случайный вектор шума (часто из нормального или равномерного распределения) и пытается преобразовать его в данные, которые выглядят как реальные․ Этот случайный вектор шума является "семенем" для каждой уникальной генерации․

Роль шума:

- Стартовая точка: Шум служит отправной точкой для генерации․ Каждый уникальный шумовой вектор приводит к уникальному выходному образцу․

- Разнообразие: Различные шумовые векторы позволяют генератору исследовать различные части пространства данных, тем самым генерируя разнообразные изображения, тексты или другие данные․ Без шума генератор всегда производил бы одно и то же․

- Предотвращение коллапса мод: Как мы уже упоминали, шум помогает избежать ситуации, когда генератор начинает производить лишь очень ограниченный набор высококачественных, но однообразных образцов․

Роль сэмплинга:

- Генерация образцов: Сам акт подачи шумового вектора на генератор и получения от него выходных данных — это и есть сэмплинг․ Мы "сэмплируем" из распределения, которое генератор научился имитировать․

- Исследование латентного пространства: Изменяя компоненты входного шумового вектора, мы можем наблюдать плавные переходы между различными сгенерированными образцами, что позволяет нам понимать, как генератор отображает латентное пространство в пространство данных․

Однако GANs часто страдают от проблемы, связанной с чувствительностью к шуму и сложностью сэмплинга: коллапс мод․ Если дискриминатор становится слишком сильным или обучение нестабильно, генератор может найти несколько "безопасных" образцов, которые легко обманывают дискриминатор, и будет генерировать только их, игнорируя все остальное разнообразие данных․ Это показывает, что хотя шум является источником разнообразия, его эффективное использование требует тонкой настройки и стабильного обучения․

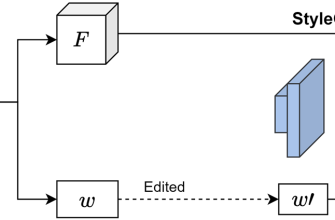

Вариационные Автокодировщики (VAEs)

VAEs подходят к генерации данных с вероятностной точки зрения․ Они состоят из двух частей: энкодера, который сжимает входные данные в латентное пространство, и декодера, который восстанавливает данные из этого латентного пространства․ В отличие от традиционных автокодировщиков, энкодер VAE не просто выводит одну точку в латентном пространстве, а выводит параметры (среднее значение и дисперсию) распределения вероятностей (обычно Гауссовского) в этом латентном пространстве․

Роль шума:

- Репараметризационный трюк: Это сердце использования шума в VAE․ Чтобы сделать процесс обучения дифференцируемым (т․е․ чтобы градиенты могли проходить через операцию сэмплирования), мы используем "репараметризационный трюк"․ Вместо того чтобы напрямую сэмплировать из распределения, энкодер генерирует среднее (μ) и логарифм дисперсии (log σ²) для латентного распределения․ Затем мы берем случайный шум (ε) из стандартного нормального распределения и вычисляем латентный вектор z = μ + σ * ε․ Этот трюк позволяет нам отделить случайность (ε) от обучаемых параметров сети (μ и σ), делая возможным обратное распространение ошибки․

- Плавное латентное пространство: Шум, вводимый через репараметризационный трюк, способствует созданию плавного и непрерывного латентного пространства․ Это означает, что небольшие изменения в латентном векторе приводят к небольшим, осмысленным изменениям в сгенерированных данных, что очень полезно для интерполяции и исследования․

Роль сэмплинга:

- Генерация новых данных: Для генерации совершенно новых данных мы просто сэмплируем случайный вектор из стандартного нормального распределения (или любого другого простого распределения, которое мы предполагали для латентного пространства), а затем подаем его на декодер․ Это позволяет нам создавать бесконечное количество новых образцов․

- Реконструкция и вариативность: При обучении VAE мы сначала кодируем входные данные в латентное распределение, затем сэмплируем из него латентный вектор (с помощью репараметризационного трюка) и декодируем его, пытаясь реконструировать исходные данные․ Введенный шум гарантирует, что даже при реконструкции есть элемент вариативности, который заставляет модель учиться более робастным и общим представлениям․

Вот как мы можем визуализировать этот процесс с помощью таблицы:

| Компонент VAE | Роль Шума | Роль Сэмплинга | Результат |

|---|---|---|---|

| Энкодер | Выдает параметры (μ, σ²) для латентного распределения, используемого в репараметризационном трюке․ | Использует случайный шум (ε) для сэмплирования латентного вектора z из распределения, заданного энкодером․ | Создание вероятностного представления входных данных в латентном пространстве․ |

| Декодер | Непосредственно не использует шум как вход (шум уже интегрирован в z)․ | Получает латентный вектор z (который содержит элемент случайности от сэмплирования) и преобразует его в выходные данные․ | Генерация новых образцов данных или реконструкция входных данных с вариациями․ |

| При генерации | Сэмплируем случайный шум (ε) из простого распределения (например, N(0,1)) для создания латентного вектора z․ | Выбираем случайный z из заранее определенного латентного распределения и подаем его на декодер․ | Создание абсолютно новых, уникальных образцов․ |

Диффузионные Модели: Новая Граница

Диффузионные модели — это относительно новое, но уже чрезвычайно влиятельное семейство генеративных моделей, таких как DALL-E 2, Midjourney, Stable Diffusion․ Их подход к использованию шума и сэмплинга радикально отличается от GANs и VAEs, и именно это делает их такими мощными․

Прямой (шумовой) процесс:

- Мы начинаем с чистого образца данных (например, изображения)․

- Постепенно, на протяжении многих маленьких шагов, мы добавляем к этому образцу контролируемое количество Гауссовского шума․

- С каждым шагом изображение становится все более и более зашумленным, пока в конце процесса не превратится в чистый шум․

- Модель учится предсказывать шум, который был добавлен на каждом шаге, или предсказывать "очищенное" изображение из зашумленного․

Обратный (генеративный/сэмплирующий) процесс:

- Это процесс генерации․ Мы начинаем с чистого Гауссовского шума (абсолютно случайного изображения)․

- Затем, используя обученную модель (которая умеет предсказывать, как убрать шум), мы итеративно, шаг за шагом, удаляем небольшие порции шума из изображения․

- На каждом шаге мы сэмплируем из условного распределения, которое говорит нам, как выглядело бы изображение на предыдущем (менее зашумленном) шаге․

- Этот процесс повторяется сотни или даже тысячи раз, пока шум полностью не будет удален, и мы не получим чистое, высококачественное изображение․

Критическая роль шума и сэмплинга:

- Контролируемое добавление/удаление шума: В диффузионных моделях шум — это не просто вход, а центральный элемент всего процесса․ Модель учится сложному отображению между зашумленными и чистыми данными․ Расписание добавления шума (noise schedule) критически важно․

- Итеративный сэмплинг: Процесс генерации, это по сути итеративный сэмплинг․ На каждом шаге мы сэмплируем из распределения, обусловленного текущим зашумленным состоянием и параметрами модели․ Это позволяет модели постепенно "выковывать" детали из случайности․

- Качество и реализм: Благодаря этому постепенному процессу удаления шума, диффузионные модели способны генерировать изображения с беспрецедентным уровнем детализации и реализма, превосходя многие другие архитектуры․

Диффузионные модели демонстрируют, как глубокое понимание и контролируемое манипулирование шумом в сочетании с итеративным сэмплингом могут привести к появлению невероятно мощных генеративных систем․ Они перевернули наше представление о том, как из хаоса может рождаться порядок и красота․

Симбиотические Отношения: Почему Они Не Могут Жить Друг Без Друга

После рассмотрения каждой концепции по отдельности и их проявлений в различных архитектурах, становится очевидным, что шум и сэмплинг — это не просто отдельные компоненты, а две стороны одной медали, находящиеся в глубоких симбиотических отношениях․ Они не могут полноценно существовать и функционировать друг без друга в мире генеративных моделей;

Мы видим, что шум предоставляет потенциал, исходный материал для творчества․ Это бесконечный источник вариаций, который позволяет модели не просто повторять то, что она видела, но и придумывать нечто новое․ Шум — это своего рода "воображение" модели, ее способность мечтать о бесчисленных возможностях․ Он гарантирует, что каждый акт генерации начинается с уникальной отправной точки, расширяя горизонты того, что модель может произвести․

Сэмплинг, с другой стороны, является актом реализации этого потенциала․ Это процесс, который превращает абстрактную случайность шума в конкретный, воспринимаемый нами результат․ Если шум, это необработанный мрамор, то сэмплинг, это руки скульптора, которые постепенно высекают из него форму․ Без сэмплинга, вся внутренняя "творческая сила" модели, ее понимание распределения данных, осталась бы невыраженной, запертой внутри нейронной сети․ Сэмплинг, это мост между внутренним представлением модели и внешним миром․

Их взаимодействие можно сравнить с процессом обучения․ Шум стимулирует исследование, заставляя модель осваивать новые области латентного пространства и генерировать разнообразные результаты․ Сэмплинг позволяет эксплуатировать это знание, извлекая конкретные, желаемые образцы․ Баланс между этими двумя аспектами является ключом к успешной генерации: слишком мало шума или неэффективный сэмплинг могут привести к ограниченному разнообразию (коллапс мод), а слишком много неконтролируемого шума или хаотичный сэмплинг — к бессмысленным результатам․

Именно в этой динамике мы обнаруживаем истинную мощь генеративного ИИ․ Это не просто воспроизведение, а создание, которое черпает вдохновение из случайности и воплощает его в структурированных формах․ Это напоминает нам о глубоких связях между порядком и хаосом, которые мы наблюдаем в природе и искусстве․

"Хаос, как мы знаем, содержит информацию․ Это не обязательно просто шум․"

— Бенуа Мандельброт

Эта цитата Бенуа Мандельброта, пионера фрактальной геометрии, идеально отражает суть нашего обсуждения․ То, что кажется хаосом (шумом), на самом деле является богатым источником информации и потенциальных структур․ Генеративные модели, по сути, учатся извлекать эту информацию из шума, интерпретировать ее и превращать в осмысленные данные через процесс сэмплинга․ Они показывают нам, что случайность не является врагом порядка, а может быть его катализатором․

Вызовы и Будущие Направления

Несмотря на впечатляющие достижения, область генеративных моделей, шума и сэмплинга сталкивается с рядом вызовов, которые активно исследуются в научном сообществе․ Мы, как исследователи и разработчики, постоянно ищем способы улучшить эти процессы, сделать их более эффективными, контролируемыми и менее ресурсоемкими․

Одним из ключевых вызовов является контроль над шумом․ Как мы можем гарантировать, что шум приводит к желаемому разнообразию, а не к бессмысленным или неправдоподобным результатам? В то время как шум необходим для креативности, его неконтролируемое использование может снизить качество генерации․ Существуют исследования в области адаптивных расписаний шума, где количество и тип добавляемого шума динамически изменяются в процессе обучения или генерации, чтобы оптимизировать результаты․

Другой важный аспект — эффективность сэмплинга․ Некоторые модели, особенно диффузионные, требуют очень большого количества итераций сэмплинга (тысячи шагов), что делает их очень требовательными к вычислительным ресурсам и медленными в генерации․ Разработка более быстрых и эффективных алгоритмов сэмплинга является приоритетной задачей․ Мы видим появление таких методов, как DDIM (Denoising Diffusion Implicit Models) и различных техник ускорения, которые сокращают количество необходимых шагов сэмплинга, сохраняя при этом высокое качество․

Кроме того, мы сталкиваемся с проблемами, связанными с оценкой качества генерации․ Как количественно измерить "хорошую" генерацию, особенно когда речь идет о творческих задачах? Метрики, такие как FID (Fréchet Inception Distance) и Inception Score, помогают, но они не всегда полностью отражают человеческое восприятие качества и креативности․ Разработка более надежных и всеобъемлющих метрик остается активной областью исследований․

Поиск Контролируемости

В будущем мы, вероятно, увидим еще больший акцент на условной генерации․ Это означает, что мы хотим не просто генерировать случайные образцы, а контролировать их атрибуты․ Например, генерировать изображение кошки определенной породы, в определенной позе и с определенным выражением морды․ Это требует более сложного взаимодействия между входным шумом и управляющими сигналами (например, текстовыми описаниями, как в DALL-E)․ Способность "направлять" шум и процесс сэмплинга к конкретным целям открывает огромные возможности для персонализации и целевого создания контента․

Мы также ожидаем увидеть новые архитектуры, которые будут более эффективно интегрировать шум и сэмплинг, возможно, черпая вдохновение из биологических систем, где случайность и порядок сосуществуют в сложной гармонии․ Исследования в области нейроморфных вычислений и более биоинспирированных подходов могут предложить новые пути для создания более гибких и креативных генеративных моделей․

Оптимизация Стратегий Сэмплинга

Работа над оптимизацией стратегий сэмплинга включает в себя не только ускорение, но и улучшение разнообразия и качества․ Мы изучаем методы, которые позволяют моделям исследовать более широкие области латентного пространства, не жертвуя при этом связностью или реализмом․ Это может включать в себя новые способы формирования латентных пространств, более продвинутые методы сэмплирования из сложных распределений или гибридные подходы, сочетающие преимущества разных типов моделей․

Также важно бороться с предвзятостью сэмплирования (sampling bias)․ Если обучающие данные содержат предвзятость (например, в них недостаточно представлены определенные группы людей), то и сгенерированные данные будут отражать эту предвзятость․ Контроль шума и сэмплинг могут быть использованы для того, чтобы помочь моделям генерировать более справедливые и репрезентативные результаты, активно стимулируя генерацию малопредставленных классов․

Мы прошли долгий путь в нашем исследовании роли шума и сэмплинга в генеративных моделях․ От понимания их фундаментальной важности в GANs и VAEs до глубокого погружения в итеративную природу диффузионных моделей, мы увидели, как эти два понятия являются не просто техническими деталями, а сердцем и душой творческого процесса искусственного интеллекта․ Шум — это не просто помеха, а источник безграничного потенциала, искра, которая зажигает искру творчества в машинах․ Сэмплинг, это искусство воплощения, процесс, который превращает эту искру в осязаемый, осмысленный результат․

Их симбиотические отношения позволяют генеративным моделям не просто воспроизводить, но и по-настоящему изобретать, исследовать, создавать․ Мы наблюдаем, как из хаоса может рождаться порядок, и как случайность, будучи правильно управляемой, становится мощнейшим инструментом в руках современного ИИ․ Будущее генеративных моделей обещает быть еще более захватывающим, поскольку мы продолжаем совершенствовать наше понимание и контроль над этими фундаментальными процессами․ Способность машин творить, вдохновляться и воплощать идеи — это не просто технологический прорыв; это глубокое переосмысление нашего собственного понимания креативности и интеллекта․ И в основе всего этого лежит удивительная, неразрывная связь между шумом и сэмплингом․

Подробнее

| Генеративные модели ИИ | Диффузионные модели | Применение GAN | Теория сэмплинга | Репараметризационный трюк |

| Латентное пространство | Шум в нейросетях | Условная генерация | Оптимизация сэмплинга | Коллапс мод GAN |