- Тайные Тени Алгоритмов: Как Смещение Разрушает Доверие к Генеративным Моделям и Что Мы Можем С Этим Сделать

- Что Такое Смещение в Контексте Генеративных Моделей?

- Корни Проблемы: Откуда Берётся Смещение?

- Смещение в Обучающих Данных (Data Bias)

- Алгоритмическое Смещение (Algorithmic Bias)

- Смещение Взаимодействия с Пользователем (Interaction Bias)

- Проявления Смещения в Генеративных Моделях: Где Мы Его Видим?

- Стереотипизация и Усиление Предрассудков

- Недостаток Разнообразия в Генерациях

- Низкое Качество Генераций для Определённых Групп

- Как Мы Можем Обнаружить Смещение? Методы и Подходы

- Анализ Обучающих Данных

- Тестирование Модели на Чувствительность

- Качественный Анализ и Человеческая Экспертиза

- Стратегии Минимизации Смещения: Наш Путь к Справедливому ИИ

- Справедливый Сбор и Курирование Данных

- Учёт Справедливости в Проектировании Модели

- Пост-Обработка Генераций

- Этические Принципы и Регулирование

Тайные Тени Алгоритмов: Как Смещение Разрушает Доверие к Генеративным Моделям и Что Мы Можем С Этим Сделать

В мире, где искусственный интеллект становится всё более неотъемлемой частью нашей повседневной жизни, генеративные модели занимают особое место. Они рисуют картины, пишут тексты, создают музыку и даже проектируют новые молекулы, открывая перед человечеством горизонты, о которых мы ещё недавно могли только мечтать. Мы, как энтузиасты и исследователи этого удивительного феномена, с восторгом наблюдаем за их прогрессом. Однако за этой завесой чудес скрывается одна из самых коварных и трудноуловимых проблем – смещение, или, как мы привыкли говорить, «баяс».

Смещение в генеративных моделях – это не просто технический недостаток; это глубоко укоренившаяся проблема, которая может привести к несправедливости, дискриминации и даже к подрыву доверия к самой технологии. Мы видим, как модели, призванные служить всем, невольно начинают отражать и усиливать предрассудки, существующие в обществе. Это происходит не потому, что их создатели злы, а потому, что мир, из которого они черпают знания, полон несовершенств. Наша задача сегодня – разобраться, откуда берётся это смещение, как оно проявляется и, самое главное, что мы, как ответственные разработчики и пользователи, можем предпринять для его минимизации.

Что Такое Смещение в Контексте Генеративных Моделей?

Прежде чем погрузиться в детали, давайте определимся с терминологией. Когда мы говорим о смещении (bias) в генеративных моделях, мы имеем в виду систематические ошибки или предпочтения, которые модель проявляет в своих выводах или генерациях. Эти ошибки не случайны; они являются результатом закономерностей, которые модель усвоила из обучающих данных или из особенностей своего алгоритма. Мы часто видим, как модель, обученная на определённом наборе данных, начинает ассоциировать определённые характеристики (например, пол, расу, социально-экономический статус) с определёнными ролями или исходами, даже если такой связи в реальности нет или она не должна быть доминирующей.

Это понятие отличается от случайной ошибки, которая может возникнуть из-за шума в данных или неточностей в вычислениях. Смещение – это структурная проблема, которая повторяется снова и снова, затрагивая определённые группы людей или типы данных. Мы, как блогеры, стремящиеся к объективности, считаем крайне важным подчеркнуть эту разницу, поскольку именно систематический характер смещения делает его таким опасным и требует целенаправленных усилий для исправления.

Корни Проблемы: Откуда Берётся Смещение?

Мы часто задаемся вопросом: если алгоритмы не имеют собственного сознания и предрассудков, почему они начинают их демонстрировать? Ответ кроется в источниках их "знаний" и методах их "обучения". Смещение не появляется из ниоткуда; оно заложено в самой основе процесса создания ИИ. Мы выделяем несколько ключевых источников, которые являються основными виновниками этой проблемы.

Смещение в Обучающих Данных (Data Bias)

Это, пожалуй, самый распространённый и очевидный источник смещения. Генеративные модели учатся на огромных массивах данных, которые отражают наш мир во всей его сложности. Но что, если этот мир сам по себе полон предрассудков? Что, если данные, которые мы собираем, неполны, несбалансированы или содержат исторические дискриминационные паттерны? Мы видим это постоянно.

- Недостаточная Репрезентация (Underrepresentation): Если в обучающем наборе данных определённые группы людей, культуры или явления представлены недостаточно, модель просто не сможет научиться адекватно их генерировать. Например, модель, обученная преимущественно на фотографиях людей европеоидной внешности, может испытывать трудности с генерацией реалистичных изображений людей других рас. Мы сталкивались с этим, когда модели "забывали" о существовании целых этнических групп.

- Историческое Смещение (Historical Bias): Данные, собранные в прошлом, могут отражать социальные нормы и предрассудки того времени. Например, тексты, написанные десятилетия назад, могут содержать стереотипы о гендерных ролях или расовой принадлежности. Модель, обученная на таких текстах, будет воспроизводить эти стереотипы в своих генерациях. Мы видим, как это приводит к тому, что модель ассоциирует "врача" с мужчиной, а "медсестру" с женщиной.

- Смещение Выборки (Sampling Bias): Даже если мир разнообразен, способ сбора данных может быть предвзятым. Если данные собираются только из определённых источников или регионов, они не будут отражать всю полноту реальности. Мы должны быть крайне осторожны при выборе источников данных.

- Смещение Аннотации (Annotation Bias): Если данные аннотируются людьми, их личные предрассудки могут проникать в метки. Например, если аннотаторы склонны по-разному оценивать поведение мужчин и женщин, модель будет учиться на этих предвзятых оценках. Мы знаем, что человеческий фактор здесь играет огромную роль.

Алгоритмическое Смещение (Algorithmic Bias)

Иногда проблема не только в данных, но и в том, как модель их обрабатывает. Даже если данные кажутся относительно сбалансированными, сам алгоритм может способствовать усилению смещения. Мы часто сталкиваемся с тем, что тонкие особенности архитектуры модели или выбранные гиперпараметры могут усугублять проблему.

- Смещение Проектирования Модели (Model Design Bias): Некоторые архитектуры моделей могут быть более склонны к определённым типам смещения. Например, модели, которые сильно зависят от локальных паттернов, могут упускать общие, но менее выраженные тенденции в данных. Мы должны тщательно выбирать архитектуру.

- Смещение Оптимизации (Optimization Bias): Функция потерь, которую мы используем для обучения модели, может неявно способствовать смещению. Если, например, функция потерь уделяет больше внимания общей точности, чем справедливости для конкретных подгрупп, модель может жертвовать точностью для меньшинств ради общей производительности. Мы должны помнить, что "точность" не всегда означает "справедливость".

Смещение Взаимодействия с Пользователем (Interaction Bias)

Смещение может возникать и после того, как модель уже обучена и развёрнута. Как пользователи взаимодействуют с моделью, какие запросы они ей дают, как интерпретируют её выводы – всё это может влиять на дальнейшее поведение модели, особенно в системах, которые постоянно дообучаются. Мы видим, как порочный круг может формироваться здесь.

- Смещение Обратной Связи (Feedback Loop Bias): Если модель используется в системе, где её выводы влияют на будущие данные (например, система рекомендаций, которая показывает пользователю только то, что он уже "предпочитал"), это может усилить существующие паттерны и сделать их ещё более доминирующими. Мы должны быть особенно осторожны с такими замкнутыми циклами.

- Смещение Применения (Application Bias): То, как мы используем генеративную модель, также может быть источником смещения. Если мы используем её для задач, для которых она не была предназначена, или если мы игнорируем её ограничения, мы можем столкнуться с нежелательными результатами. Мы должны всегда учитывать контекст использования.

Проявления Смещения в Генеративных Моделях: Где Мы Его Видим?

Мы, как блогеры, стремящиеся к ясности, считаем, что недостаточно просто знать о существовании смещения; необходимо понимать, как оно проявляется в реальных генерациях. Эти проявления могут быть тонкими и едва заметными, но их совокупное воздействие может быть разрушительным. Мы видели это на примерах, которые порой шокировали своей откровенностью.

Стереотипизация и Усиление Предрассудков

Одним из самых очевидных проявлений смещения является воспроизведение и усиление социальных стереотипов. Генеративные модели, обученные на обширных текстовых и визуальных данных, часто усваивают ассоциации, которые, к сожалению, распространены в обществе.

- Гендерные Стереотипы: Мы часто наблюдаем, как языковые модели ассоциируют определённые профессии (например, инженер, генеральный директор) с мужчинами, а другие (например, медсестра, секретарь) – с женщинами. Визуальные генеративные модели, когда им дают запрос "профессионал", склонны генерировать изображения мужчин.

- Расовые и Этнические Стереотипы: Модели могут генерировать изображения или тексты, которые ассоциируют определённые расовые или этнические группы с бедностью, преступностью или другими негативными характеристиками. Мы видели случаи, когда запросы на "красивое лицо" приводили к доминированию определённых этнических черт.

- Стереотипы по Возрасту и Социальному Статусу: Также мы замечаем, как модели могут ассоциировать старость с немощью или бедностью, а богатство – с определёнными стилями одежды или местами проживания.

Недостаток Разнообразия в Генерациях

Когда модель обучена на несбалансированных данных, она не только воспроизводит стереотипы, но и просто не может генерировать разнообразные и инклюзивные результаты. Это приводит к монотонности и исключению целых групп.

- Игнорирование Меньшинств: Если определённые группы недостаточно представлены в обучающих данных, модель может просто "забыть" о них. Мы видели, как запросы на "парад" могут игнорировать культурные особенности и разнообразие парадов по всему миру, фокусируясь на одном доминирующем типе.

Низкое Качество Генераций для Определённых Групп

Смещение проявляется не только в содержании, но и в качестве. Модель может работать очень хорошо для большинства, но демонстрировать значительно худшие результаты для меньшинств.

- Различия в Детализации: Мы замечаем, что изображения людей определённой расы или пола могут быть менее детализированными, более размытыми или содержать больше артефактов по сравнению с изображениями доминирующих групп.

- Ошибки и Неточности: Языковые модели могут допускать больше грамматических ошибок или выдавать менее связные тексты при обсуждении тем, связанных с недостаточно представленными культурами или группами. Мы, как пользователи, быстро замечаем такие несоответствия.

«Технологии сами по себе не являются ни добром, ни злом. Добром или злом их делает то, как мы их используем, и какие ценности мы в них закладываем.»

— Сатья Наделла (Satya Nadella), генеральный директор Microsoft

Как Мы Можем Обнаружить Смещение? Методы и Подходы

Обнаружение смещения – это первый и критически важный шаг к его устранению. Мы не можем исправить то, что не видим. Однако, учитывая сложность генеративных моделей и их "чёрный ящик", обнаружение смещения может быть непростой задачей. Мы, как исследователи, разработали ряд подходов, которые помогают нам выявлять эти скрытые тени.

Анализ Обучающих Данных

Мы всегда начинаем с изучения источника проблемы – данных. Если данные несбалансированы, модель почти наверняка будет смещена. Мы используем различные методы для анализа данных.

- Статистический Анализ: Мы проводим количественный анализ распределения различных атрибутов (например, пола, расы, возраста) в обучающем наборе данных. Мы ищем дисбалансы, перекосы и пропущенные значения.

- Визуализация Данных: Графическое представление данных помогает нам быстро выявить аномалии и неравномерное распределение. Мы строим гистограммы, диаграммы рассеяния и тепловые карты.

- Оценка Репрезентативности: Мы сравниваем распределение атрибутов в наших данных с известными демографическими данными населения, чтобы понять, насколько хорошо наш набор данных отражает реальный мир.

Тестирование Модели на Чувствительность

После обучения модели мы активно тестируем её, чтобы понять, как она реагирует на изменения во входных данных, особенно тех, что связаны с чувствительными атрибутами.

- Систематическое Тестирование с Вариациями: Мы подаём модели запросы, которые систематически изменяют чувствительные атрибуты. Например, для генерации изображений мы можем запросить "инженер" и "инженер-женщина", "инженер-мужчина", "инженер азиатской внешности" и т.д., чтобы увидеть, как изменяются результаты.

- Использование Метрик Справедливости: Мы применяем специальные метрики, разработанные для оценки справедливости ИИ. Эти метрики могут измерять, например, равные шансы, равное покрытие или демографический паритет между различными группами.

Качественный Анализ и Человеческая Экспертиза

Несмотря на все наши автоматизированные инструменты, человеческий глаз и критическое мышление остаются незаменимыми. Мы всегда включаем качественный анализ в наш процесс.

- Экспертная Оценка: Группа экспертов из разных областей (этика, социология, культура) просматривает генерации модели и оценивает их на предмет предвзятости, стереотипов и неадекватности. Мы часто обнаруживаем тонкие нюансы, которые алгоритмы могут пропустить.

- Краудсорсинг и Пользовательская Обратная Связь: Привлечение широкой аудитории для оценки результатов модели может выявить смещения, которые не были очевидны для небольшой команды разработчиков. Мы ценим каждый отзыв.

Стратегии Минимизации Смещения: Наш Путь к Справедливому ИИ

Обнаружение смещения – это лишь полдела. Самое сложное и ответственное – это разработка и применение стратегий для его минимизации. Мы убеждены, что борьба со смещением должна быть многогранной и охватывать весь жизненный цикл генеративной модели, от сбора данных до её развёртывания и мониторинга. Мы не ищем идеального решения, но стремимся к постоянному улучшению.

Справедливый Сбор и Курирование Данных

Поскольку данные являются основным источником смещения, мы уделяем первостепенное внимание их качеству и репрезентативности.

| Стратегия | Описание | Примеры Применения |

|---|---|---|

| Расширение Разнообразия Источников | Мы активно ищем данные из разнообразных географических, культурных и социальных источников, чтобы обеспечить более полное представление мира. | Включение новостных статей из разных стран, использование изображений людей со всего мира. |

| Балансировка Данных | Мы используем методы перебалансировки классов (oversampling, undersampling) для групп, которые недостаточно представлены в данных. | Искусственное увеличение количества примеров для меньшинств или уменьшение для большинства. |

| Удаление Стереотипов | Мы проводим ручную и автоматизированную очистку данных от явных стереотипов и предрассудков. | Фильтрация текстов, содержащих дискриминационную лексику; удаление пометок, отражающих предвзятость. |

| Добавление Контекста | В некоторых случаях мы обогащаем данные дополнительной информацией, которая помогает модели лучше понять нюансы. | Добавление метаданных к изображениям, указывающих на культурный контекст или демографическую группу. |

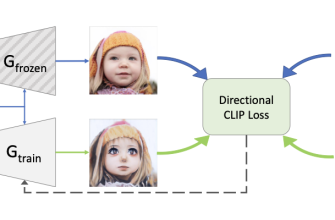

Учёт Справедливости в Проектировании Модели

Мы не можем полагаться только на данные; сам алгоритм должен быть разработан с учётом принципов справедливости. Мы исследуем различные архитектурные и оптимизационные подходы.

- Справедливые Функции Потерь (Fairness-Aware Loss Functions): Мы можем модифицировать функции потерь, чтобы они не только минимизировали ошибку, но и учитывали справедливость между различными группами. Это может включать добавление штрафов за несправедливое поведение.

- Дебиасинг Векторных Представлений (Debiasing Word Embeddings): Для языковых моделей мы применяем методы, которые удаляют гендерные, расовые или другие стереотипы из векторных представлений слов. Это помогает модели мыслить более нейтрально.

- Интерпретируемость Моделей (Model Interpretability): Создание более интерпретируемых моделей помогает нам понять, почему модель принимает те или иные решения, и выявить скрытые смещения. Мы используем методы XAI (Explainable AI), чтобы "заглянуть" внутрь "чёрного ящика".

- Использование Аугментации Данных, Сфокусированной на Справедливости: Мы можем генерировать синтетические данные, которые дополняют недостающие группы или изменяют атрибуты в существующих данных, чтобы сделать их более сбалансированными.

Пост-Обработка Генераций

Даже если мы приложили все усилия на этапах данных и обучения, смещение всё равно может проявиться. Поэтому мы применяем методы пост-обработки для корректировки результатов модели.

- Фильтрация и Редактирование: Мы можем использовать дополнительные фильтры или редакторы, которые анализируют генерации модели на предмет стереотипов и корректируют их. Например, если модель генерирует текст, который ассоциирует "инженера" только с мужчинами, мы можем предложить варианты с нейтральным языком или женскими примерами.

- Переранжирование (Re-ranking): В системах, которые генерируют несколько вариантов, мы можем переранжировать их, чтобы продвигать более разнообразные и непредвзятые результаты.

- Усиление Разнообразия: Мы можем специально добавлять разнообразие в генерации, если модель склонна к монотонности. Например, для генерации изображений мы можем немного изменять атрибуты, чтобы получить более широкий спектр результатов.

Этические Принципы и Регулирование

Мы верим, что технические решения должны идти рука об руку с этическими рамками и, при необходимости, с регулированием. Создание справедливого ИИ – это не только инженерная задача, но и социальная.

- Разработка Этических Руководств: Мы активно участвуем в разработке внутренних и внешних этических руководств для создания и использования ИИ. Эти руководства помогают нам принимать ответственные решения на каждом этапе.

- Включение Разнообразных Команд: Мы убеждены, что команды разработчиков должны быть разнообразными по полу, расе, культурному бэкграунду и жизненному опыту. Разнообразие в команде помогает выявлять и предотвращать смещения, которые могут быть незаметны для гомогенной группы.

- Прозрачность и Отчётность: Мы стремимся к большей прозрачности в том, как собираются данные, как обучаются модели и какие потенциальные смещения они могут содержать. Мы также выступаем за механизмы отчётности, которые позволяют пользователям сообщать о случаях предвзятости.

Проблемы смещения в генеративных моделях – это сложная и многомерная задача, не имеющая простого решения. Мы, как блогеры, искренне увлечённые миром ИИ, понимаем, что это не просто технический баг, который можно исправить одним патчем. Это отражение глубоко укоренившихся социальных, культурных и исторических предрассудков, которые невольно проникают в наши алгоритмы через данные, на которых они обучаются. Наш путь к созданию по-настоящему справедливого и инклюзивного искусственного интеллекта – это непрерывный процесс обучения, адаптации и критического самоанализа.

Мы убеждены, что ответственность за минимизацию смещения лежит на всех нас: разработчиках, исследователях, политиках и пользователях. Мы должны быть бдительными на каждом этапе: от тщательного курирования обучающих данных и разработки алгоритмов, ориентированных на справедливость, до постоянного мониторинга моделей в реальном мире и готовности корректировать их поведение. Это требует междисциплинарного подхода, объединяющего техническую экспертизу с этическими, социальными и гуманитарными знаниями. Наша цель – не просто создать машины, которые генерируют впечатляющие результаты, но и системы, которые служат всему человечеству, не усиливая неравенство, а способствуя справедливости и пониманию.

Мы верим, что с каждым днём, с каждым новым исследованием и с каждой открытой дискуссией мы приближаемся к этой цели; Генеративные модели обладают огромным потенциалом для творчества и инноваций, и наша задача – обеспечить, чтобы этот потенциал был реализован во благо всех, а не избранных; Мы призываем всех присоединиться к этому диалогу, делиться своим опытом и вместе строить будущее, где искусственный интеллект будет истинным отражением нашего лучшего "мы".

На этом статья заканчиваеться точка..

Подробнее

| Смещение в ИИ | Генеративные Модели | Этика Искусственного Интеллекта | Fairness AI | Data Bias |

| Algorithmic Bias | Debiasing Techniques | Инклюзивный ИИ | Ответственный ИИ | Мониторинг Смещения |