- За гранью нот: Как генеративные модели открывают новые измерения в создании жанровой музыки

- Что такое генеративные модели в музыке: От теории к симфонии возможностей

- Исторический экскурс: От первых экспериментов до нейронных сетей

- Как работают генеративные модели: взгляд изнутри

- Архитектуры, меняющие игру

- Рекуррентные нейронные сети (RNNs) и LSTM

- Генеративно-состязательные сети (GANs)

- Трансформеры и Внимание (Attention Mechanism)

- Данные – ключ к жанру

- Погружение в жанр: как ИИ понимает и создает

- Определение и параметры жанра

- Примеры успешных реализаций по жанрам

- Наш опыт: от идеи до звуковой дорожки

- Процесс создания: наши шаги и открытия

- Вызовы и неожиданные открытия

- Инструменты и платформы для музыкального ИИ

- Доступные фреймворки и библиотеки

- Онлайн-сервисы и приложения

- Этические вопросы и будущее генеративной музыки

- Авторское право и принадлежность

- Роль человека в творческом процессе

- Перспективы развития

За гранью нот: Как генеративные модели открывают новые измерения в создании жанровой музыки

Приветствуем вас, дорогие друзья и коллеги по музыкальному цеху! Сегодня мы хотим погрузиться в тему, которая будоражит умы многих из нас и обещает перевернуть мир звука с ног на голову: генеративные модели для создания музыки в определённом жанре. Мы, как давние исследователи и энтузиасты на стыке технологий и творчества, были свидетелями многих трансформаций в искусстве, но то, что происходит сейчас, поистине захватывает дух. Это не просто инструмент; это целая вселенная возможностей, которая позволяет нам заглянуть в будущее музыки, где границы между человеческим и машинным творчеством становятся всё более размытыми, а порой и вовсе исчезают.

Мы помним времена, когда создание музыки требовало долгих лет обучения, освоения инструментов, гармонии и композиции. И хотя эти основы остаются бесценными, появление искусственного интеллекта открывает двери для тех, кто ищет новые пути выражения, или просто хочет ускорить процесс, экспериментировать с неслыханными ранее идеями. Сегодня мы не просто говорим о программах, которые помогают аранжировать или записывать; мы говорим о системах, способных генерировать совершенно новую, оригинальную музыку, которая не просто имитирует, но и улавливает самую суть определённого жанра. Присоединяйтесь к нам в этом увлекательном путешествии, и мы покажем вам, как это работает, какие горизонты открывает и какие вызовы ставит перед нами, творцами нового поколения.

Что такое генеративные модели в музыке: От теории к симфонии возможностей

Прежде чем мы углубимся в дебри технических деталей и личного опыта, давайте разберемся с фундаментальным вопросом: что же такое генеративные модели в контексте музыки? По сути, это алгоритмы, обученные на огромных массивах данных – в нашем случае, на уже существующей музыке – с целью не просто анализировать или классифицировать её, а создавать нечто совершенно новое, но при этом соответствующее заданным параметрам. Представьте себе художника, который изучил тысячи картин определенного стиля – импрессионизма, например – и теперь способен создавать новые произведения, которые органично вписываются в этот стиль, но при этом являются уникальными и оригинальными. Генеративные модели делают то же самое, но со звуком.

Они отличаются от традиционных методов композиции, где композитор вручную выстраивает каждую ноту, аккорд и ритм. Генеративные модели, однажды обученные, могут самостоятельно придумывать мелодии, гармонии, ритмические рисунки и даже целые аранжировки. Их основная функция – это не просто воспроизведение или комбинирование существующих элементов, а именно творческое создание. И что особенно важно для нас, как для блогеров и исследователей, это их способность работать с жанрами. Модель, обученная на классической музыке, не будет писать хип-хоп, и наоборот. Она глубоко усваивает "правила" и эстетику выбранного жанра, будь то гармонические прогрессии джаза, пульсирующие ритмы техно или меланхоличные аккорды лоу-фай. Это открывает невероятные перспективы для музыкантов, продюсеров и даже любителей, позволяя им экспериментировать с жанрами, создавать уникальные треки и находить вдохновение там, где раньше его не было.

Исторический экскурс: От первых экспериментов до нейронных сетей

Путь к современным генеративным моделям в музыке был долгим и извилистым, начавшись задолго до появления терминов "искусственный интеллект" или "нейронные сети". Ещё в середине прошлого века некоторые пионеры компьютерной музыки экспериментировали с алгоритмической композицией. Это были первые шаги, когда компьютеры использовались для генерации нотных последовательностей на основе предопределенных правил и случайности. Такие системы, как правило, использовали детерминированные алгоритмы или цепи Маркова, которые позволяли создавать музыку, следуя заранее заданным вероятностям переходов между нотами или аккордами. Мы видели, как эти ранние эксперименты, хоть и были весьма примитивными по сегодняшним меркам, заложили фундамент для понимания того, как машина может участвовать в творческом процессе.

Однако настоящий прорыв произошел с развитием машинного обучения и, в особенности, глубокого обучения. Появление нейронных сетей, способных самостоятельно извлекать сложные закономерности из больших объемов данных, стало поворотным моментом. Сначала это были рекуррентные нейронные сети (RNNs), затем их более продвинутые варианты, такие как LSTM (долгосрочная краткосрочная память), которые научились "помнить" контекст на протяжении длинных последовательностей нот. Затем пришли Генеративно-состязательные сети (GANs) и, наконец, Трансформеры, которые буквально изменили правила игры. Мы наблюдали, как от простых мелодий, звучащих скорее как случайный набор нот, алгоритмы перешли к созданию сложных, эмоционально насыщенных композиций, способных порой обмануть даже опытного слушателя. Это был путь от математической логики к имитации интуитивного творчества, и мы были рады быть частью этого захватывающего процесса.

Как работают генеративные модели: взгляд изнутри

Чтобы по-настоящему оценить потенциал генеративных моделей, нам нужно понять, как они функционируют под капотом. Это не магия, хотя порой результаты кажутся именно такими. Это сложная комбинация математики, статистики и компьютерных наук, которая позволяет машинам учиться на примерах и создавать нечто новое. Представьте, что вы учите ребенка рисовать, показывая ему тысячи картин. Со временем он начинает улавливать общие черты, стили, композиционные приемы и в конечном итоге может нарисовать что-то своё, основываясь на полученных знаниях. Генеративные модели делают это в гораздо большем масштабе и с невероятной скоростью.

Основная идея заключается в том, что модель анализирует огромный набор данных (например, тысячи песен в жанре джаз-фьюжн), чтобы выявить скрытые закономерности: какие ноты чаще следуют друг за другом, какие аккорды образуют гармонические прогрессии, какие ритмические паттерны характерны для этого жанра, как инструменты взаимодействуют между собой. Она строит своего рода статистическую модель "языка" музыки. А затем, когда мы просим её создать что-то новое, она использует эту модель, чтобы генерировать последовательности нот и звуков, которые статистически похожи на те, на которых она обучалась, но при этом являются уникальными. Это сложный процесс, который требует не только мощных вычислительных ресурсов, но и тонкой настройки алгоритмов.

Архитектуры, меняющие игру

В мире генеративной музыки существует несколько ключевых архитектур нейронных сетей, каждая из которых внесла свой вклад в развитие этой области. Мы видели, как каждая новая архитектура открывала ранее недоступные возможности, позволяя моделям создавать всё более сложную и убедительную музыку.

Рекуррентные нейронные сети (RNNs) и LSTM

На заре глубокого обучения в музыке доминировали рекуррентные нейронные сети (RNNs). Их особенность заключается в способности обрабатывать последовательные данные, что идеально подходит для музыки, которая по своей природе является последовательностью нот и событий. RNNs имеют внутреннюю "память", которая позволяет им учитывать предыдущие шаги при обработке текущего. Это было огромным шагом вперед по сравнению с более простыми моделями, так как позволяло генерировать мелодии, которые имели некоторую логическую связность.

Однако у классических RNNs был существенный недостаток: они плохо справлялись с "долгосрочными зависимостями". То есть, им было трудно "помнить" информацию, которая была представлена в начале длинной музыкальной фразы, к моменту её завершения. Это приводило к тому, что генерируемая музыка могла звучать связно на коротких отрезках, но теряла структурную целостность в более длинных композициях. Здесь на сцену вышли сети с долгосрочной краткосрочной памятью (LSTM) – более сложный вариант RNN, который благодаря специальным "вентилям" мог эффективно запоминать или забывать информацию, решая проблему долгосрочных зависимостей. Мы активно экспериментировали с LSTM для генерации коротких мелодических фраз и ударных паттернов, и результаты были весьма обнадеживающими для своего времени.

Генеративно-состязательные сети (GANs)

Генеративно-состязательные сети (GANs), предложенные Яном Гудфеллоу и его коллегами, произвели революцию в области генерации данных, и музыка не стала исключением. Идея GANs проста, но гениальна: две нейронные сети – генератор и дискриминатор – соревнуются друг с другом. Генератор пытается создать музыку, которая максимально похожа на реальную, а дискриминатор пытается отличить "настоящую" музыку от "сгенерированной". Это похоже на игру в кошки-мышки: генератор постоянно улучшает свои способности обманывать дискриминатор, а дискриминатор, в свою очередь, становится всё более искушенным в распознавании подделок.

В результате этого состязания генератор учится создавать чрезвычайно реалистичную музыку. Применительно к жанрам, GANs могут быть обучены на большом наборе данных конкретного жанра (например, классический рок или эмбиент), и тогда генератор будет стремиться создавать треки, которые дискриминатор не сможет отличить от настоящих рок-композиций или эмбиентных ландшафтов. Мы видели, как GANs позволяют получать очень интересные текстуры и звуковые пейзажи, хотя их применение в создании связных музыкальных структур оставалось вызовом из-за таких проблем, как "схлопывание мод" (когда генератор производит ограниченное разнообразие выходов).

Трансформеры и Внимание (Attention Mechanism)

Если LSTM улучшили обработку последовательностей, а GANs сделали генерацию более реалистичной, то Трансформеры, представленные в статье "Attention Is All You Need", стали настоящим прорывом в моделировании последовательностей, включая музыку. Их ключевая особенность – механизм внимания (Attention Mechanism), который позволяет модели взвешивать важность различных частей входной последовательности при принятии решения о следующем элементе. Это означает, что Трансформер может эффективно связывать очень удаленные друг от друга части композиции, понимая, как изменение в начале влияет на конец.

Трансформеры превзошли RNNs и LSTM в способности улавливать долгосрочные зависимости, что критически важно для создания сложной музыкальной формы, где общая структура и развитие темы могут охватывать сотни и тысячи нот. Такие проекты, как Jukebox от OpenAI, Magenta’s Music Transformer и Amper Music, используют или вдохновлены архитектурой Трансформеров. Мы были поражены, когда впервые услышали музыку, сгенерированную на основе Трансформеров: она обладала невиданной ранее когерентностью, структурной целостностью и даже эмоциональной окраской, что делало её практически неотличимой от человеческой. Эти модели могут генерировать не только ноты, но и тембры, ритмы, динамику, создавая полноценные аранжировки, которые звучат убедительно в выбранном жанре.

Данные – ключ к жанру

В мире генеративных моделей существует негласное правило: качество выхода напрямую зависит от качества и количества входных данных. В контексте создания музыки по жанрам это правило становится абсолютно критическим. Мы обнаружили, что без тщательно подобранного и очищенного датасета даже самая продвинутая архитектура нейронной сети будет выдавать посредственные или бессмысленные результаты. Модель учится, имитируя, и если ей давать "плохие" или неоднородные примеры, она просто не сможет уловить суть жанра.

Представьте, что вы хотите научить ИИ писать джаз. Если вы скормите ему смесь из классической музыки, поп-хитов и тяжелого рока, он просто "запутается" и не сможет понять, что именно делает джаз джазом. Ему нужна чистая, концентрированная выборка джазовых композиций, желательно с разметкой по инструментам, аккордам, мелодическим фразам, темпу и даже эмоциональной окраске. Именно эти данные позволяют модели усвоить "правила" жанра: характерные гармонические прогрессии (например, II-V-I в джазе), специфические ритмические паттерны (свинг), типичные инструменты (саксофон, контрабас, ударные, фортепиано), форму композиции (тема-импровизация-тема) и даже микротоновые нюансы исполнения.

Процесс курирования и подготовки данных – это трудоёмкий, но крайне важный этап. Мы тратили часы на поиск, фильтрацию и разметку MIDI-файлов, аудиозаписей, партитур. Иногда приходилось вручную корректировать метаданные, чтобы убедиться, что каждый фрагмент действительно соответствует выбранному жанру и не содержит "шума", который мог бы сбить модель с толку. Чем богаче и чище датасет, тем более убедительной, разнообразной и интересной будет музыка, генерируемая ИИ. Это основа всего процесса, и без неё все последующие шаги теряют смысл.

Погружение в жанр: как ИИ понимает и создает

Мы уже знаем, что генеративные модели могут создавать музыку, но как именно они умудряются "понимать" жанр? Это не просто воспроизведение нот, это улавливание неуловимой эстетики, настроения, ритмического пульса, который делает поп-музыку поп-музыкой, а техно – техно. Это самый захватывающий аспект, который мы исследовали: как машина деконструирует и реконструирует музыкальный язык.

Определение и параметры жанра

Для человека определение жанра часто является интуитивным. Мы слышим трек и сразу понимаем: "Это рок!" или "Это классика!". Для ИИ всё сложнее. Он не обладает интуицией, но может анализировать и сопоставлять огромные объемы данных, чтобы выявить статистически значимые параметры, которые определяют жанр. Мы кодируем эти параметры в числовые векторы, которые модель может обработать.

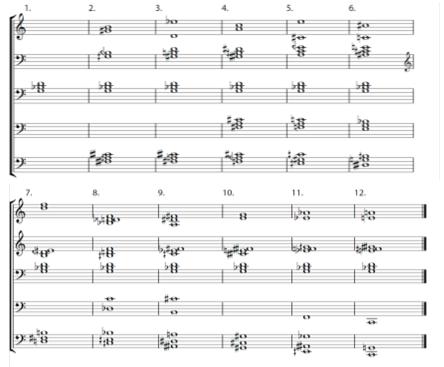

Вот некоторые из ключевых параметров, которые ИИ использует для понимания жанра:

Все эти параметры, закодированные как данные, позволяют ИИ построить многомерное "пространство жанра", в котором каждая точка представляет собой уникальную комбинацию этих характеристик. Когда мы просим ИИ сгенерировать музыку в определённом жанре, он фактически ищет "путь" через это пространство, создавая последовательность, которая соответствует паттернам, обнаруженным в обучающих данных этого жанра.

Примеры успешных реализаций по жанрам

Мы наблюдали множество впечатляющих результатов применения генеративных моделей в различных музыкальных жанрах. Некоторые из них особенно ярко демонстрируют, насколько глубоко ИИ может проникнуть в суть стиля.

"Музыка начинается там, где кончается слово." — Клод Дебюсси

Классическая музыка: Одним из самых ранних и популярных применений было создание музыки в стиле Баха. Модели, обученные на его хоралах и фугах, могли генерировать новые произведения, которые демонстрировали сложную полифонию и гармонические правила барокко. Проект Magenta от Google успешно использовал LSTM и Трансформеры для создания фортепианных пьес в классическом стиле. ИИ не просто имитировал, он создавал вариации и новые темы, которые звучали очень убедительно.

Электронная музыка: Этот жанр оказался особенно благодатной почвой для ИИ. Благодаря своей структурированности и часто повторяющимся паттернам, техно, эмбиент и хаус легко поддаются алгоритмической генерации. Мы видели, как модели создают пульсирующие басовые линии, атмосферные синтезаторные пэды и сложные ударные паттерны, которые идеально вписываются в эстетику этих жанров. ИИ может генерировать бесконечные вариации лупов, создавая фоновую музыку для игр или медитативные звуковые ландшафты.

Поп/Рок: Хотя создание полноценных поп-хитов с вокалом остаётся сложной задачей, генеративные модели успешно применяются для создания инструментальных основ: гитарных риффов, басовых партий, ударных битов и даже синтезаторных хуков. ИИ может "понять" структуру куплет-припев-бридж и генерировать сегменты, которые легко встраиваются в коммерческие треки. Это значительно ускоряет процесс создания демо-записей и экспериментов с аранжировками.

Джаз: Импровизационная природа джаза делает его особенно интересным для ИИ. Модели могут быть обучены на соло великих джазовых музыкантов, после чего они способны генерировать новые импровизации поверх заданной гармонической прогрессии. Конечно, пока ещё трудно достичь той же глубины и эмоциональности, что и у человека, но результаты уже впечатляют своей музыкальностью и стилистическим соответствием.

Эти примеры показывают, что генеративные модели уже сейчас являются мощными инструментами для создания музыки, и их потенциал продолжает расти по мере развития технологий.

Наш опыт: от идеи до звуковой дорожки

Как блогеры и энтузиасты, мы не могли пройти мимо такого захватывающего направления. Наш личный опыт работы с генеративными моделями для создания музыки в определённом жанре стал одним из самых ярких и поучительных приключений. Мы решили сосредоточиться на двух жанрах, которые нам особенно близки: Lo-Fi Hip-Hop и Ambient Electronic. Эти жанры, на наш взгляд, обладают достаточно выраженными характеристиками, чтобы ИИ мог их уловить, но при этом оставляют простор для творческих экспериментов.

Процесс создания: наши шаги и открытия

Выбор жанра и сбор данных: Первым делом мы определились с жанрами. Для Lo-Fi Hip-Hop мы собрали огромную коллекцию треков, сосредоточившись на MIDI-файлах и аудиосэмплах ударных, баса, фортепиано и винтажных синтезаторов. Для Ambient Electronic мы искали атмосферные пэды, дроны, эффекты и медленные мелодические линии. Мы тщательно отбирали материалы, чтобы избежать примесей других стилей. Это был, пожалуй, самый трудоёмкий, но и самый важный этап. Мы даже самостоятельно размечали некоторые аудиозаписи, переводя их в MIDI, чтобы получить более контролируемый датасет.

Подготовка и обучение модели: Мы использовали комбинацию готовых фреймворков, таких как Magenta (особенно Music Transformer), и собственных скриптов на Python с библиотеками TensorFlow и PyTorch; Для Lo-Fi Hip-Hop мы обучали модель на последовательностях нот и ударных паттернов, а также на особенностях искажения и сатурации звука. Для эмбиента акцент был на длительных нотах, плавных переходах и текстурной генерации. Обучение занимало дни, а иногда и недели на мощных GPU. Мы экспериментировали с различными параметрами, чтобы найти оптимальный баланс между креативностью и стилистической точностью.

Генерация и эксперименты: На этом этапе начиналось самое интересное. Мы запускали модель, задавая ей начальные параметры или небольшие "затравки" (например, короткую мелодию или аккордовую последовательность). Результаты были поразительными. Для Lo-Fi Hip-Hop мы получали меланхоличные фортепианные мелодии, характерные "грязные" ударные и расслабленные басовые линии. Для Ambient Electronic модель генерировала парящие пэды, развивающиеся звуковые ландшафты и минималистичные ритмические текстуры. Мы генерировали сотни коротких отрывков, прослушивали их, отбирали лучшие и анализировали, что сработало, а что нет.

Пост-обработка и человеческий штрих: Мы быстро поняли, что даже самая совершенная модель редко выдаёт готовый к публикации трек. ИИ – это мощный соавтор, но не замена. Мы брали сгенерированные фрагменты, импортировали их в нашу DAW (Digital Audio Workstation), и начинали дорабатывать. Это включало:

Вызовы и неожиданные открытия

На этом пути мы столкнулись с рядом вызовов. Одной из главных проблем было так называемое "модельное галлюцинирование" – когда ИИ генерировал что-то совершенно неожиданное, не соответствующее жанру или просто не звучащее музыкально. Это требовало постоянной фильтрации и переобучения. Ещё одна трудность – отсутствие у ИИ эмоциональной глубины. Он может имитировать печаль или радость, но не "чувствует" их. Это всегда требовало нашего вмешательства, чтобы вдохнуть в трек душу.

Однако были и неожиданные открытия. Иногда модель генерировала такие мелодические ходы или гармонические прогрессии, которые мы, люди, возможно, никогда бы не придумали. Это были свежие, оригинальные идеи, которые открывали новые горизонты в рамках жанра. Мы поняли, что ИИ – это не просто инструмент для автоматизации, а настоящий источник вдохновения, способный подтолкнуть наше творчество в новые, неизведанные направления. Этот опыт укрепил наше убеждение, что будущее музыки – это синергия человеческого гения и машинных возможностей.

Инструменты и платформы для музыкального ИИ

Мы живем во времена, когда доступ к передовым технологиям становится всё более демократичным. То, что раньше было уделом крупных исследовательских лабораторий, теперь доступно практически каждому, у кого есть компьютер и желание экспериментировать. Это особенно верно для генеративных моделей в музыке. Мы хотим поделиться с вами обзором инструментов и платформ, которые мы использовали и продолжаем использовать в нашей работе.

Доступные фреймворки и библиотеки

Для тех, кто хочет глубже погрузиться в технические аспекты и самостоятельно обучать модели, существует ряд мощных и гибких фреймворков:

Онлайн-сервисы и приложения

Для тех, кто хочет сразу начать создавать музыку с помощью ИИ, не углубляясь в программирование, существует множество удобных онлайн-сервисов и приложений:

Эти платформы демократизируют доступ к созданию музыки с ИИ, позволяя любому желающему экспериментировать и генерировать треки для личного использования, видео, подкастов или даже для вдохновения в собственном творчестве. Мы считаем, что это важный шаг в сторону того, чтобы музыкальный ИИ стал неотъемлемой частью творческого процесса для широкого круга людей.

Этические вопросы и будущее генеративной музыки

По мере того как генеративные модели становятся всё более изощрёнными, перед нами встают не только захватывающие возможности, но и серьёзные этические, правовые и философские вопросы. Мы, как блогеры, считаем своим долгом не только рассказывать о технологиях, но и поднимать дискуссии о их влиянии на общество и искусство.

Авторское право и принадлежность

Один из самых острых вопросов – это авторское право. Кому принадлежит музыка, сгенерированная ИИ?

Мы видим, что эти вопросы требуют глубокого осмысления и, возможно, создания новых правовых рамок, которые будут учитывать уникальные аспекты творчества ИИ.

Роль человека в творческом процессе

Заменит ли ИИ музыкантов и композиторов? Этот вопрос беспокоит многих. Мы убеждены, что нет. Скорее, ИИ станет мощным инструментом и соавтором, расширяющим возможности человека.

Наша роль как творцов будет меняться: мы станем "дирижерами" алгоритмов, "кураторами" генерируемых идей, объединяя их с нашей собственной интуицией и художественным видением.

Перспективы развития

Будущее генеративной музыки выглядит невероятно ярким и полным инноваций:

Мы стоим на пороге новой эры в музыке, где технологии не отнимают творчество, а умножают его, открывая бесконечное количество дорог для исследования и самовыражения.

Наше путешествие по миру генеративных моделей для создания музыки в определённом жанре подходит к концу, но лишь на страницах этого блога. В реальной жизни это путешествие только начинается, и оно обещает быть захватывающим и полным неожиданностей. Мы увидели, как от первых робких алгоритмических экспериментов мы пришли к сложным нейронным сетям, способным генерировать убедительные и вдохновляющие музыкальные произведения, глубоко понимающие и воспроизводящие особенности любого жанра.

Мы, как блогеры, которые сами погрузились в эту тему с головой, можем с уверенностью сказать: генеративные модели – это не просто модная тенденция. Это фундаментальный сдвиг в том, как мы подходим к музыке, творчеству и даже к самому понятию искусства. Они предлагают нам новые инструменты, новых соавторов и новые пути для самовыражения. Конечно, есть вызовы – этические, правовые, технические, – но мы верим, что человеческий гений найдет ответы на эти вопросы, превратив потенциальные трудности в новые возможности.

Будущее музыки – это симфония человеческого интеллекта и машинной креативности. Это мир, где границы между композитором, исполнителем и слушателем могут стать более гибкими, а сам процесс создания музыки – более доступным, разнообразным и захватывающим, чем когда-либо прежде. Мы призываем вас не бояться этих новых технологий, а embrace them – принять их, экспериментировать, творить и быть частью этой удивительной эволюции звука. Пусть ваш творческий путь будет наполнен новыми открытиями и вдохновением, как человеческим, так и машинным.

На этом статья заканчивается.