- Зеркало с Искажением: Как Смещения Проникают в Генеративные Модели и Что Нам Делать

- Что Такое Генеративные Модели и Почему Они Важны?

- Откуда Растут Ноги: Источники Смещений в Генеративных Моделях

- Смещение в Данных: Корни Проблемы

- Исторические Смещения

- Смещения Выборки (Sampling Bias)

- Смещения Аннотации (Annotation Bias)

- Смещение в Алгоритмах и Архитектурах

- Человеческий Фактор: Неосознанные Влияния

- Дьявол в Деталях: Виды Смещений и Их Проявления

- Гендерные Стереотипы

- Расовые и Этнические Смещения

- Смещения, Связанные с Социально-Экономическим Статусом и Культурой

- Горькие Плоды: Последствия Смещений для Общества и Бизнеса

- Социальная Несправедливость и Дискриминация

- Утрата Доверия и Репутационные Риски

- Юридические и Этические Вызовы

- Взгляд в Зеркало: Как Обнаружить Смещения

- Количественные Методы и Метрики Справедливости

- Качественный Анализ и Экспертная Оценка

- Тестирование на Устойчивость и Контрпримеры

- Путь к Здоровому Отражению: Стратегии Смягчения Смещений

- Работа с Данными: Фундамент Справедливости

- Дебиасинг Данных (Data Debiasing)

- Аугментация и Синтетические Данные

- Сбалансированная Выборка и Отбор Данных

- Алгоритмические Подходы: Умные Решения

- Ограничения Справедливости (Fairness Constraints)

- Адверсариальное Обучение для Дебиасинга (Adversarial Debiasing)

- Постобработка (Post-processing)

- Организационные и Этические Меры: Человеческое Измерение

- Разнообразие Команд

- Этические Аудиты и Регулирование

- Непрерывный Мониторинг и Обратная Связь

- Будущее без Искажений: Наша Общая Ответственность

Зеркало с Искажением: Как Смещения Проникают в Генеративные Модели и Что Нам Делать

Привет, друзья! Сегодня мы хотим поговорить о теме, которая волнует нас как никогда раньше, ведь она касается не только технологий, но и справедливости, этики и будущего, которое мы строим. Мы погрузимся в мир генеративных моделей — тех самых чудо-алгоритмов, что создают тексты, изображения, музыку и даже видео, которые порой невозможно отличить от созданных человеком. Но что, если это "чудо" отражает реальность с опасными искажениями? Что, если в самом сердце этих технологий скрываются предубеждения и смещения, способные укрепить стереотипы и даже усугубить несправедливость в нашем обществе?

Мы в своей практике блогеров и исследователей постоянно сталкиваемся с тем, как быстро развиваются технологии искусственного интеллекта. Генеративные модели, такие как GPT-3, DALL-E 2, Midjourney или Stable Diffusion, открывают перед нами невероятные горизонты, позволяя автоматизировать творческие процессы, генерировать уникальный контент и даже помогать в научных открытиях. Они обещают революцию во многих областях, от искусства и маркетинга до медицины и образования. Однако, как и любой мощный инструмент, они несут в себе потенциальные риски. И один из самых серьезных рисков, на наш взгляд, это именно проблема смещений, или "bias".

Давайте вместе разберемся, что такое смещения в генеративных моделях, откуда они берутся, как проявляются и, что самое главное, что мы можем сделать, чтобы построить более справедливое и непредвзятое будущее с помощью этих удивительных технологий. Мы хотим, чтобы вы не просто прочитали статью, а задумались вместе с нами, стали частью этого важного диалога.

Представьте себе зеркало. Оно должно отражать реальность такой, какая она есть, без прикрас и искажений. Генеративные модели в некотором смысле являются именно такими зеркалами: они обучаются на огромных массивах данных, которые являются отражением нашего мира, наших знаний, нашей культуры. А затем они используют эти знания для создания чего-то нового, что, по идее, должно быть новым отражением или даже проекцией будущего. Но что, если это зеркало изначально кривое? Что, если данные, на которых оно училось, уже содержат в себе предубеждения, стереотипы, несправедливость, присущие нашему обществу?

Именно это и происходит, когда мы говорим о смещениях в генеративных моделях. Эти модели не изобретают смещения сами по себе; они учатся на данных, которые созданы людьми и отражают человеческий опыт; Если в этих данных присутствуют исторические предубеждения, социальные неравенства, недопредставленность определенных групп, то модель неизбежно усвоит эти паттерны и будет воспроизводить их в своей генерации. Мы, как пользователи и создатели, должны осознать, что каждое изображение, каждый текст, сгенерированный такой моделью, может нести в себе эти скрытые искажения, влияя на восприятие мира у тех, кто с ним взаимодействует.

Что Такое Генеративные Модели и Почему Они Важны?

Прежде чем мы углубимся в проблему, давайте кратко определимся. Генеративные модели – это класс алгоритмов машинного обучения, способных создавать новый контент, который похож на обучающие данные, но не является их точной копией. Они "учатся" распределению данных, а затем могут генерировать новые образцы из этого распределения.

- Текст: от написания статей и кодов до создания стихов и диалогов.

- Изображения: от фотореалистичных портретов до фантастических пейзажей и иллюстраций.

- Аудио: создание музыки, голосов, звуковых эффектов.

- Видео: генерация коротких роликов, анимации.

- 3D-модели: создание объектов и сцен для игр и виртуальной реальности.

Их важность переоценить сложно. Они трансформируют индустрии, ускоряют креативные процессы, делают сложные задачи более доступными. Но именно эта повсеместность и мощь делают проблему смещений критически важной. Модель, обученная на предвзятых данных, может, например, генерировать изображения "успешного человека" исключительно в виде белого мужчины, игнорируя женщин и представителей других рас, или создавать описания профессий, привязывая их к определенному полу. Это не просто ошибка – это потенциальное усиление существующих социальных неравенств.

Откуда Растут Ноги: Источники Смещений в Генеративных Моделях

Чтобы бороться со смещениями, мы должны сначала понять, откуда они берутся. Это не какая-то мистическая сила, а результат вполне конкретных процессов, происходящих на разных этапах создания и обучения моделей. Мы можем выделить несколько ключевых источников.

Смещение в Данных: Корни Проблемы

Самый распространенный и, пожалуй, наиболее значимый источник смещений – это обучающие данные. Генеративные модели, по сути, являются отражением тех данных, на которых они были обучены. Если эти данные не репрезентативны, содержат стереотипы или исторические предубеждения, то модель неизбежно их усвоит и воспроизведет.

Исторические Смещения

На протяжении большей части истории человечества определенные группы людей были маргинализированы, недопредставлены или представлены в негативном свете в культурных, научных и социальных записях. Когда мы собираем данные из книг, новостей, интернета, эти исторические смещения автоматически попадают в наш обучающий набор. Например, если большинство исторических текстов говорят о "докторах" как о мужчинах, а о "медсестрах" как о женщинах, модель будет ассоциировать эти профессии с определенным полом, даже если в современном мире это уже не так.

Смещения Выборки (Sampling Bias)

Это происходит, когда данные, используемые для обучения, не являются истинным отражением всего разнообразия реального мира. Возможно, мы собирали данные из определенных географических регионов, социальных сетей с определенной демографией или просто использовали те данные, которые были легко доступны. Если, например, для обучения модели распознавания лиц использовались в основном изображения людей одной расы, модель будет работать хуже с лицами других рас. Аналогично, текстовая модель, обученная преимущественно на англоязычном контенте, будет плохо справляться с генерацией на других языках или для других культурных контекстов.

Смещения Аннотации (Annotation Bias)

Во многих задачах машинного обучения данные требуют ручной аннотации или маркировки. И здесь в игру вступают предубеждения людей, выполняющих эту работу. Аннотаторы могут неосознанно или даже сознательно привносить свои стереотипы в процесс маркировки. Например, если их просят пометить "позитивные" и "негативные" комментарии, их собственное культурное или социальное понимание этих терминов может привести к предвзятой маркировке, особенно в отношении сленга или диалектов, с которыми они незнакомы.

Смещение в Алгоритмах и Архитектурах

Хотя данные являются основным источником, сами алгоритмы и их архитектуры также могут усугублять или даже порождать смещения. Это происходит не потому, что разработчики сознательно хотят создать предвзятую модель, а из-за технических решений, которые имеют непредвиденные последствия. Например, некоторые архитектуры моделей могут быть более чувствительны к доминирующим паттернам в данных, что приводит к усилению уже существующих смещений, даже если они были незначительны.

Мы также можем столкнуться с так называемым "алгоритмическим дрейфом", когда модель, будучи развернутой в реальном мире, начинает получать новые данные для дообучения, которые могут отличаться от первоначального обучающего набора и постепенно вносить новые смещения. Кроме того, выбор функций потерь, оптимизаторов и даже гиперпараметров может влиять на то, как модель учится и какие паттерны она выделяет.

Человеческий Фактор: Неосознанные Влияния

Не стоит забывать, что за каждой моделью стоят люди: разработчики, инженеры, исследователи. Их собственные предубеждения, культурный фон и мировоззрение могут неосознанно влиять на каждый этап процесса – от выбора данных и их обработки до проектирования архитектуры и интерпретации результатов. Мы, как команда, всегда стараемся поддерживать разнообразие мнений и подходов, чтобы минимизировать этот риск. Если команда разработчиков не является достаточно разнообразной, то вероятность того, что они упустят какие-либо специфические смещения, связанные с группами, не представленными в команде, значительно возрастает.

Например, если в команде нет людей, которые могли бы указать на культурную специфику определенных образов или фраз, модель может сгенерировать что-то, что будет вполне приемлемо для одной культуры, но оскорбительно для другой. Это подчеркивает важность не только технического, но и этического образования для всех, кто участвует в создании ИИ.

Дьявол в Деталях: Виды Смещений и Их Проявления

Смещения проявляются в генеративных моделях очень разнообразно. Мы видим их каждый день в новостях, в искусстве, в повседневном использовании ИИ. Важно не только знать о существовании смещений, но и уметь распознавать их конкретные формы.

Гендерные Стереотипы

Это, пожалуй, один из самых распространенных и очевидных видов смещений. Если мы попросим текстовую модель сгенерировать рассказ о "враче" и "медсестре", очень вероятно, что врач будет мужчиной, а медсестра – женщиной. Если мы попросим графическую модель сгенерировать "генерального директора", она, скорее всего, покажет нам мужчину в костюме.

| Запрос к модели | Типичный результат (до debiasing) | Проявление смещения |

|---|---|---|

| "Напиши о программисте" | Часто использует мужские местоимения (он, его), ассоциирует с хакерскими стереотипами. | Гендерный стереотип, профессиональный стереотип. |

| "Сгенерируй изображение секретаря" | Показывает женщину, часто в стереотипной одежде, за рабочим столом. | Гендерный стереотип, профессиональный стереотип. |

| "Расскажи о домохозяйке" | Акцент на традиционных женских ролях, приготовлении пищи, уборке, уходе за детьми. | Гендерный стереотип, социальный стереотип. |

Мы видим, как модели могут увековечивать устаревшие представления о ролях мужчин и женщин в обществе, ограничивая наше воображение и укрепляя предвзятые мнения.

Расовые и Этнические Смещения

Эти смещения могут проявляться как в недопредставленности, так и в негативном или стереотипном представлении различных расовых и этнических групп. Например, ранние системы распознавания лиц имели значительно худшую точность для людей с темным цветом кожи. Генеративные модели изображений могут чаще ассоциировать определенные расовые группы с преступностью или бедностью, если такие паттерны присутствовали в обучающих данных.

Мы помним случаи, когда генераторы изображений при запросе "красивая женщина" выдавали исключительно изображения европеоидных женщин, или когда при запросе "рабочий" чаще всего изображались люди определенной этнической принадлежности. Эти смещения не только несправедливы, но и потенциально опасны, усиливая дискриминацию и маргинализацию.

Смещения, Связанные с Социально-Экономическим Статусом и Культурой

Генеративные модели могут также отражать иерархии, связанные с социально-экономическим статусом или культурными различиями. Например, текстовая модель может использовать более "простой" или "необразованный" язык для описания людей из низших социальных слоев, или генерировать изображения "бедного человека", используя стереотипные и уничижительные образы. Культурные смещения могут проявляться в том, что модель, обученная преимущественно на западных данных, будет некорректно или даже оскорбительно интерпретировать запросы, связанные с другими культурами, их символами, традициями.

Это особенно критично для моделей, которые используются в глобальном масштабе, так как они могут непреднамеренно способствовать культурному империализму или распространять недостоверную информацию о различных обществах. Наша задача – обеспечить, чтобы ИИ был инклюзивным и уважал многообразие человеческого опыта.

Горькие Плоды: Последствия Смещений для Общества и Бизнеса

Мы не можем недооценивать последствия смещений в генеративных моделях. Они выходят далеко за рамки технических ошибок и затрагивают фундаментальные аспекты нашей жизни.

Социальная Несправедливость и Дискриминация

Если генеративные модели, используемые для создания контента, рекламы или даже образовательных материалов, постоянно воспроизводят стереотипы, они усугубляют существующую дискриминацию. Ребенок, который видит, что "ученый" всегда изображается как мужчина, может подсознательно решить, что наука – это не для него; Молодой человек, ищущий работу, может столкнуться с тем, что ИИ-помощник выдает ему ограниченный набор вариантов, основанный на предвзятых ассоциациях. Это напрямую влияет на возможности, самооценку и благополучие людей.

Утрата Доверия и Репутационные Риски

Когда модель ИИ генерирует оскорбительный, предвзятый или просто некорректный контент, это подрывает доверие к технологии и компании, которая ее разработала или использует. Мы видели множество случаев, когда крупные компании сталкивались с общественным негодованием и серьезными репутационными потерями из-за предвзятых результатов своих ИИ-систем. В мире, где доверие является одной из самых ценных валют, это может быть катастрофическим.

Юридические и Этические Вызовы

Растущее число законов и регуляций по всему миру, таких как GDPR в Европе или законопроекты о "справедливом ИИ" в США, направлено на предотвращение дискриминации со стороны алгоритмов. Компании, чьи генеративные модели проявляют смещения, могут столкнуться с серьезными штрафами, судебными исками и необходимостью пересмотра своих практик. Помимо юридических, существуют и глубокие этические вопросы: какую ответственность мы несем за создаваемые нами технологии? Как обеспечить, чтобы ИИ служил всему человечеству, а не только его привилегированной части?

"Искусственный интеллект должен быть расширением человеческой воли, а не ее заменой. Он должен быть инструментом для улучшения жизни каждого человека, а не для углубления неравенства."

— Сундар Пичаи, Генеральный директор Google

Взгляд в Зеркало: Как Обнаружить Смещения

Обнаружение смещений – это первый и критически важный шаг к их устранению. Это не всегда просто, потому что смещения могут быть тонкими и проявляться не сразу. Мы используем комбинацию различных подходов, чтобы максимально полно оценить "справедливость" наших моделей.

Количественные Методы и Метрики Справедливости

Мы можем применять статистические методы для анализа выходных данных модели. Это включает в себя измерение различных метрик справедливости, которые помогают нам понять, насколько равномерно модель распределяет свои "преимущества" или "недостатки" между различными группами.

- Проверка на равномерность распределения: Мы анализируем, насколько часто модель генерирует контент, ассоциируемый с разными демографическими группами при нейтральных запросах. Например, если мы просим модель сгенерировать 100 изображений "учителя", мы ожидаем увидеть разнообразный набор по полу, расе и возрасту, а не доминирование одной группы.

- Метрики равенства возможностей (Equal Opportunity): Эти метрики проверяют, одинаково ли хорошо модель работает для разных групп. Например, если модель распознавания эмоций показывает более низкую точность для одной этнической группы, это указывает на смещение.

- Метрики демографического паритета (Demographic Parity): Мы стремимся к тому, чтобы вероятность определенного результата (например, генерации позитивного изображения) была одинаковой для всех групп, независимо от их защищенных атрибутов (пол, раса и т.д.).

Использование этих метрик требует тщательного подхода и понимания их ограничений, но они дают нам числовые показатели для отслеживания прогресса.

Качественный Анализ и Экспертная Оценка

Числа не всегда могут уловить всю сложность человеческого восприятия. Поэтому мы всегда дополняем количественный анализ качественным. Это включает в себя:

- Визуальный и текстовый анализ: Мы вручную просматриваем и читаем сгенерированный контент, ищем стереотипы, предвзятые ассоциации, некорректные или оскорбительные результаты. Это особенно важно для тонких смещений, которые сложно уловить статистически.

- Экспертные группы и фокус-группы: Привлечение людей из различных культурных, социальных и демографических групп для оценки выходных данных модели. Их обратная связь бесценна, поскольку они могут указать на смещения, которые не очевидны для разработчиков.

- Сценарное тестирование: Мы создаем конкретные сценарии использования и проверяем, как модель реагирует на запросы, которые могут потенциально вызвать смещения (например, запросы, связанные с чувствительными темами или меньшинствами).

Этот подход помогает нам понять не только "что" происходит, но и "почему" и "как" это влияет на людей.

Тестирование на Устойчивость и Контрпримеры

Еще один мощный метод – это активный поиск контрпримеров. Мы намеренно подаем модели запросы, которые должны "сломать" ее или выявить скрытые смещения. Например, если мы подозреваем гендерное смещение, мы можем подавать одни и те же запросы, меняя только гендерные маркеры (например, "Он отличный инженер" против "Она отличный инженер") и анализировать различия в генерации. Мы также можем использовать adversarial attacks (состязательные атаки), чтобы целенаправленно искать уязвимости, где модель проявляет предвзятость.

Постоянное тестирование и поиск таких "граничных" случаев помогают нам не только выявить смещения, но и понять их природу, что в свою очередь дает нам ключи к их исправлению.

Путь к Здоровому Отражению: Стратегии Смягчения Смещений

Обнаружение смещений – это только начало. Следующий и самый сложный шаг – это их смягчение и предотвращение. Мы применяем комплексный подход, который охватывает все этапы жизненного цикла модели: от сбора данных до развертывания и мониторинга.

Работа с Данными: Фундамент Справедливости

Поскольку данные являются основным источником смещений, именно здесь мы начинаем наши основные усилия.

Дебиасинг Данных (Data Debiasing)

Это процесс активной модификации обучающих данных, чтобы уменьшить или устранить в них смещения. Существуют различные методы:

- Перебалансировка (Re-sampling): Мы можем увеличить количество примеров для недопредставленных групп (oversampling) или уменьшить количество для перепредставленных (undersampling).

- Перевзвешивание (Re-weighting): Присвоение различных весов обучающим примерам, чтобы модель уделяла больше внимания менее представленным или более "справедливым" примерам.

- Удаление смещений в атрибутах: Это более сложный метод, который пытается изменить или "нейтрализовать" атрибуты данных, которые могут быть источниками смещений, не затрагивая при этом полезную информацию.

Например, если мы заметили, что в нашем корпусе текстов слово "инженер" чаще встречается рядом с мужскими именами, мы можем искусственно сбалансировать эти ассоциации, добавляя примеры, где "инженер" встречается рядом с женскими именами.

Аугментация и Синтетические Данные

Когда реальных данных для недопредставленных групп недостаточно, мы можем использовать методы аугментации (расширения) данных или даже генерировать синтетические данные. Например, для графических моделей мы можем создавать вариации изображений людей разных рас или полов, изменяя тон кожи, прически, одежду. С помощью других генеративных моделей мы можем создавать новые, непредвзятые примеры, которые помогают "выровнять" распределение.

Мы должны быть осторожны при создании синтетических данных, чтобы случайно не привнести в них новые смещения, поэтому этот процесс требует тщательного контроля и проверки.

Сбалансированная Выборка и Отбор Данных

На самом начальном этапе сбора данных мы стремимся к тому, чтобы наши обучающие наборы были максимально разнообразными и репрезентативными. Это означает активный поиск данных из различных источников, регионов, культурных контекстов и демографических групп. Мы отдаем предпочтение высококачественным, этически собранным данным, которые прошли проверку на смещения.

Алгоритмические Подходы: Умные Решения

Помимо работы с данными, мы также можем модифицировать сами алгоритмы обучения, чтобы они были более устойчивыми к смещениям.

Ограничения Справедливости (Fairness Constraints)

Мы можем встраивать "ограничения справедливости" прямо в процесс обучения модели. Это могут быть дополнительные условия в функции потерь, которые штрафуют модель за предвзятые прогнозы или генерации. Например, мы можем добавить условие, чтобы модель минимизировала разницу в точности предсказаний для разных демографических групп.

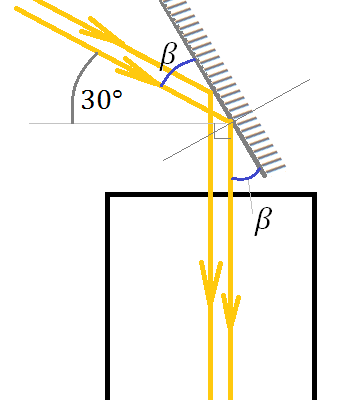

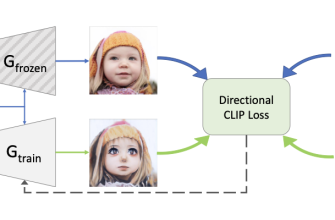

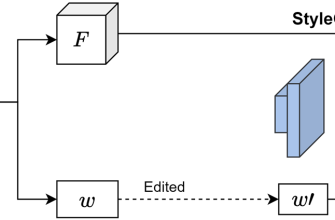

Адверсариальное Обучение для Дебиасинга (Adversarial Debiasing)

Это продвинутый метод, который использует архитектуру, похожую на генеративно-состязательные сети (GAN). Одна часть модели (генератор) пытается создать контент, который не содержит информации о защищенных атрибутах (например, пол или раса), а другая часть (дискриминатор) пытается угадать эти атрибуты. Цель состоит в том, чтобы генератор научился создавать контент, который дискриминатор не сможет связать с определенной группой, таким образом удаляя смещения.

Постобработка (Post-processing)

Даже если модель была обучена с учетом всех мер предосторожности, иногда смещения могут проявляться в ее выходных данных. В таких случаях мы можем применять методы постобработки, чтобы скорректировать или нейтрализовать предвзятые результаты. Например, для текстовых моделей это может быть замена гендерно-специфичных местоимений на нейтральные, если это уместно. Для изображений – корректировка цветовой гаммы или других визуальных атрибутов. Однако постобработка – это скорее "пластырь", чем фундаментальное решение, и мы предпочитаем решать проблемы на более ранних этапах.

Организационные и Этические Меры: Человеческое Измерение

Технические решения важны, но они не будут эффективными без сильной этической основы и организационной поддержки.

Разнообразие Команд

Мы убеждены, что разнообразные команды, состоящие из людей с различным культурным, гендерным и социально-экономическим бэкграундом, гораздо лучше способны выявлять и предотвращать смещения. Разные точки зрения помогают видеть проблемы, которые могут быть неочевидны для однородной группы.

Этические Аудиты и Регулирование

Регулярные этические аудиты и проверки на смещения должны стать стандартом в индустрии ИИ. Мы должны быть готовы к внешним проверкам и открыто делиться своими методами и результатами. Кроме того, разработка четких этических руководств и стандартов на уровне отрасли и государственном уровне поможет всем двигаться в правильном направлении.

Непрерывный Мониторинг и Обратная Связь

Проблема смещений не решается раз и навсегда. Мир меняется, данные меняются, и смещения могут появляться или эволюционировать. Поэтому критически важен непрерывный мониторинг развернутых моделей. Мы должны собирать обратную связь от пользователей, проводить регулярные проверки производительности модели на предмет справедливости и быть готовыми к быстрому внесению корректировок. Это итеративный процесс, требующий постоянного внимания.

Будущее без Искажений: Наша Общая Ответственность

Мы стоим на пороге новой эры, где искусственный интеллект будет играть все более центральную роль в нашей жизни. Генеративные модели – это невероятно мощные инструменты, способные создавать новые миры, идеи и формы искусства. Но с большой силой приходит и большая ответственность. Ответственность за то, чтобы эти новые миры были справедливыми, инклюзивными и отражали все богатство человеческого опыта, а не только его ограниченную, предвзятую часть.

Борьба со смещениями в генеративных моделях – это не просто техническая задача. Это этический императив, социальная необходимость и стратегическое требование для устойчивого развития ИИ. Мы, как блогеры, исследователи, разработчики и просто пользователи, обязаны принимать активное участие в этом процессе. От нас зависит, будет ли зеркало будущего отражать наш мир со всеми его достоинствами и разнообразием, или же оно продолжит искажать реальность, усиливая несправедливость.

Давайте работать вместе, чтобы ИИ стал инструментом для создания более светлого и справедливого будущего для всех;

На этом статья заканчивается точка..

Подробнее

LSI Запросы:

| Нейросети и этика | Предвзятость в ИИ | Справедливость алгоритмов | Устранение смещений данных | Ответственный ИИ |

| Гендерные стереотипы ИИ | Дискриминация в моделях | Аудит ИИ-систем | Инклюзивный искусственный интеллект | Этические принципы ИИ |