- Зеркало с Искажениями: Почему генеративные модели иногда показывают нам не то‚ что мы хотим видеть

- Что такое генеративные модели и почему они так важны для нас?

- Смещение (Bias) в ИИ: Не просто человеческая ошибка

- Источники смещения: Откуда оно берется?

- Виды смещений: С чем мы сталкиваемся на практике?

- Последствия смещения: От несправедливости до опасности

- Как мы выявляем смещения: Методы и инструменты

- Как мы боремся со смещениями: Стратегии и методы коррекции

- Предобработка данных (Pre-processing techniques)

- Коррекция в процессе обучения (In-processing techniques)

- Постобработка результатов (Post-processing techniques)

- Этические аспекты и наша ответственность

- Взгляд в будущее: К справедливому и этичному ИИ

Зеркало с Искажениями: Почему генеративные модели иногда показывают нам не то‚ что мы хотим видеть

Привет‚ друзья и коллеги по цифровому пространству! Сегодня мы хотим поговорить о теме‚ которая‚ возможно‚ не так часто мелькает в заголовках новостей‚ но имеет колоссальное значение для будущего технологий‚ с которыми мы ежедневно сталкиваемся․ Мы говорим о генеративных моделях – этих удивительных инструментах‚ способных творить‚ писать‚ рисовать и даже создавать музыку․ Они обещают нам мир‚ где творчество не имеет границ‚ а рутина автоматизирована до предела․ Но‚ как и любое зеркало‚ они могут отражать не только наши мечты‚ но и наши самые глубокие‚ порой неосознанные‚ предубеждения․

Наш опыт работы с этими моделями заставил нас задуматься: что‚ если эти мощные алгоритмы‚ которые мы так старательно обучаем‚ не просто генерируют что-то новое‚ а усиливают и распространяют уже существующие в обществе смещения? Что‚ если в погоне за эффективностью и скоростью мы упускаем из виду эти невидимые искажения‚ которые могут привести к несправедливым‚ а иногда и опасным результатам? В этой статье мы приглашаем вас вместе с нами погрузиться в мир проблем смещения (bias) в генеративных моделях‚ понять их природу‚ источники и‚ самое главное‚ найти пути решения․

Что такое генеративные модели и почему они так важны для нас?

Прежде чем говорить о проблемах‚ давайте вспомним‚ что же такое генеративные модели․ Если коротко‚ это тип искусственного интеллекта‚ который учится на огромных объемах данных‚ чтобы затем создавать новые данные‚ которые по своим характеристикам похожи на обучающие․ Представьте себе художника‚ который изучил тысячи картин разных стилей и теперь может самостоятельно нарисовать новую‚ уникальную работу‚ не копируя ни одну из ранее виденных․ Именно так работают генеративные модели: они не просто запоминают‚ они понимают структуру и закономерности данных‚ чтобы потом творить․

Мы видим их повсюду: от систем‚ дописывающих за вас текст в электронной почте‚ до сложных алгоритмов‚ создающих фотореалистичные изображения по текстовому описанию․ Они могут генерировать синтетические голоса‚ писать программный код‚ разрабатывать новые лекарства и даже помогать в научных открытиях․ Их потенциал настолько огромен‚ что мы‚ как общество‚ возлагаем на них большие надежды в самых разных сферах – от развлечений до медицины и образования․ Это поистине революционная технология‚ которая меняет наше взаимодействие с цифровым миром․

Наш энтузиазм по отношению к этим моделям понятен: они открывают двери в новые измерения творчества и эффективности․ Мы можем создавать контент быстрее‚ персонализировать опыт пользователей на беспрецедентном уровне и автоматизировать задачи‚ которые ранее требовали значительных человеческих ресурсов․ Однако‚ именно эта способность к "творчеству" и воспроизведению закономерностей делает их особенно уязвимыми к проблеме‚ о которой мы сегодня говорим – к смещению․

Смещение (Bias) в ИИ: Не просто человеческая ошибка

Когда мы говорим о смещении в контексте ИИ‚ многие поначалу думают о человеческих ошибках или предубеждениях․ И это отчасти верно‚ но не совсем․ Смещение в генеративных моделях – это систематическая ошибка или несправедливость‚ которая проявляется в результатах работы модели и является следствием несбалансированных‚ нерепрезентативных или предвзятых данных‚ на которых модель обучалась․ Это не означает‚ что модель "злая" или "предубежденная" в человеческом смысле․ Она просто отражает то‚ что "видела" в своих обучающих данных․

Представьте‚ что вы учите ребенка‚ показывая ему только фотографии мужчин-врачей и женщин-медсестер․ Когда вы попросите его нарисовать врача‚ он‚ скорее всего‚ нарисует мужчину‚ а медсестру – женщину․ Это не потому‚ что ребенок предубежден‚ а потому‚ что его опыт обучения был ограничен и предвзят․ Точно так же работают и генеративные модели; Они не способны мыслить критически о данных‚ которые им предоставляются; они лишь воспроизводят и экстраполируют паттерны․ И вот тут-то и кроется главная проблема: если паттерны в данных содержат дискриминацию‚ стереотипы или исторические несправедливости‚ модель их усвоит и будет продолжать воспроизводить․

Мы часто сталкиваемся с тем‚ что люди недооценивают серьезность этой проблемы‚ считая ее лишь техническим нюансом․ Но на самом деле‚ смещение в ИИ имеет далеко идущие социальные и этические последствия‚ которые могут затронуть каждого из нас․ Это не просто "баг в коде"‚ это отражение наших собственных общественных проблем‚ усиленное и автоматизированное мощью современных алгоритмов․

Источники смещения: Откуда оно берется?

Понимание источников смещения – это первый шаг к его устранению․ Мы выделяем несколько ключевых областей‚ где могут скрываться корни этой проблемы․ Это не всегда очевидно‚ и часто смещение является результатом сложного взаимодействия различных факторов․

- Данные обучения: Это‚ пожалуй‚ самый распространенный и значительный источник․

- Недостаточная репрезентативность: Если в данных отсутствует информация о определенных группах людей‚ культурах или явлениях‚ модель не сможет их адекватно представлять․ Например‚ если модель обучалась только на текстах на английском языке‚ она будет плохо работать с другими языками или культурными нюансами․

- Историческое смещение: Данные часто отражают прошлые и текущие социальные несправедливости․ Если в историческом наборе данных мужчины чаще занимали руководящие должности‚ а женщины – секретарей‚ модель будет ассоциировать эти роли с соответствующим полом․

- Стереотипное смещение: Данные могут содержать или усиливать стереотипы․ Если поисковые запросы или изображения‚ связанные с определенными профессиями‚ чаще ассоциируются с одним полом или расой‚ модель будет воспроизводить эти стереотипы в своих генерациях․

- Проектирование и архитектура модели: Иногда само устройство алгоритма может способствовать смещению․

- Особенности алгоритмов: Некоторые алгоритмы могут быть более чувствительны к определенным видам смещения в данных․ Например‚ если модель слишком сильно ориентирована на минимизацию ошибок без учета справедливости‚ она может жертвовать точностью для меньшинств ради общей производительности․

- Выбор признаков: Какие данные мы выбираем для обучения‚ какие признаки выделяем‚ тоже влияет на результат․ Если мы включаем в модель признаки‚ которые коррелируют с дискриминационными характеристиками (например‚ почтовый индекс‚ который может быть связан с социально-экономическим статусом и расовой принадлежностью)‚ модель может использовать их для принятия предвзятых решений․

- Взаимодействие с человеком и обратная связь: Даже после обучения модель может приобретать смещения․

- Человеческая разметка: Если люди‚ размечающие данные‚ сами имеют предубеждения‚ эти предубеждения будут перенесены в обучающий набор․

- Loop обратной связи: Если модель начинает выдавать предвзятые результаты‚ и эти результаты затем используются для дальнейшего обучения (например‚ через клики пользователей или их оценку)‚ смещение может усиливаться со временем‚ создавая порочный круг․

Наш блогерский опыт показывает‚ что именно эти источники часто остаются незамеченными на ранних стадиях разработки․ Мы‚ как разработчики и пользователи‚ должны быть крайне внимательны к каждому этапу жизненного цикла генеративной модели‚ чтобы минимизировать риски возникновения и усиления смещения․

Виды смещений: С чем мы сталкиваемся на практике?

Проблема смещения не является однородной․ Мы выделяем различные типы‚ каждый из которых имеет свои особенности и требует специфических подходов к выявлению и коррекции․ Понимание этих видов помогает нам более прицельно работать над улучшением моделей․

Вот некоторые из наиболее распространенных видов смещений‚ с которыми мы часто сталкиваемся:

| Вид смещения | Описание | Пример в генеративной модели |

|---|---|---|

| Историческое смещение | Отражает несправедливости‚ существовавшие в обществе на момент сбора данных․ | Модель‚ генерирующая изображения "ученых"‚ преимущественно показывает мужчин европеоидной внешности‚ потому что исторически большинство ученых в обучающих данных были таковыми․ |

| Стереотипное смещение | Усиливает или воспроизводит общественные стереотипы о группах людей․ | Генератор текста‚ при запросе "помощник по дому" чаще ассоциирует его с женским полом‚ а "инженер" – с мужским․ |

| Представительское смещение (Representation Bias) | Недостаточное или искаженное представление определенных групп в обучающих данных․ | Генератор лиц создает лица преимущественно светлой кожи‚ если обучался на данных‚ где преобладали такие лица‚ затрудняя генерацию лиц других рас․ |

| Смещение измерения (Measurement Bias) | Неточности или различия в способах сбора данных для разных групп․ | Генеративная модель для диагностики заболеваний‚ обученная на данных‚ собранных в основном в одной географической области с определенными медицинскими протоколами‚ может быть менее точной для пациентов из других регионов․ |

| Агрегационное смещение (Aggregation Bias) | Когда модель‚ обученная на агрегированных данных‚ плохо работает для отдельных подгрупп․ | Модель‚ генерирующая персонализированные рекомендации‚ может хорошо работать для большинства пользователей‚ но полностью игнорировать интересы нишевых групп‚ усредняя их потребности․ |

Мы видим‚ что эти виды смещений могут пересекаться и усиливать друг друга‚ создавая сложную сеть проблем‚ которые требуют комплексного подхода к решению․ Отслеживание и категоризация смещений – важная часть нашей работы по созданию более справедливого ИИ․

Последствия смещения: От несправедливости до опасности

За красивыми словами о "нейронных сетях" и "глубоком обучении" скрываются реальные последствия для людей и общества․ Игнорирование смещений в генеративных моделях – это не просто академическая оплошность; это может привести к серьезным‚ порой разрушительным результатам․ Мы уже видели‚ как это проявляется на практике․

- Дискриминация и несправедливость: Пожалуй‚ самое очевидное последствие; Генеративные модели‚ обученные на предвзятых данных‚ могут воспроизводить или даже усиливать дискриминацию по расовому‚ гендерному‚ возрастному или другим признакам․

- Например‚ системы генерации лиц‚ которые плохо работают для людей с темным цветом кожи‚ или текстовые генераторы‚ которые ассоциируют определенные профессии с конкретным полом;

- Системы‚ генерирующие контент для рекламных кампаний‚ могут неосознанно исключать определенные демографические группы из целевой аудитории‚ тем самым усиливая социальное неравенство․

"Истинный тест прогресса заключается не в том‚ можем ли мы добавить изобилие к тем‚ у кого его уже много‚ а в том‚ можем ли мы обеспечить достаточно для тех‚ у кого его слишком мало․"

— Франклин Д․ Рузвельт

Эта цитата‚ хотя и не о прямом ИИ‚ прекрасно отражает этическую суть проблемы смещения․ Наш прогресс в создании мощных генеративных моделей не должен увеличивать разрыв между теми‚ кто имеет привилегии‚ и теми‚ кто их лишен‚ а должен стремиться к справедливому и равноправному распределению возможностей для всех․

Наш коллективный опыт показывает‚ что осознание этих последствий – это не просто вопрос "быть хорошими"‚ это фундаментальный аспект ответственной разработки и внедрения технологий․ Мы не можем позволить себе игнорировать эти риски‚ особенно когда речь идет о системах‚ которые все глубже проникают в нашу повседневную жизнь․

Как мы выявляем смещения: Методы и инструменты

Выявление смещений – это сложная‚ но абсолютно необходимая задача․ Это не всегда очевидно‚ и часто требуется глубокий анализ как данных‚ так и самой модели․ Мы разработали и используем ряд подходов‚ чтобы "подсветить" скрытые проблемы․

Процесс выявления смещений часто начинается задолго до того‚ как модель увидит свет‚ и продолжается на протяжении всего ее жизненного цикла․ Мы выделяем несколько ключевых этапов и методов:

- Анализ обучающих данных (Data Audit):

- Статистический анализ: Мы изучаем распределение различных демографических и социальных признаков в наших данных․ Есть ли группы‚ которые недопредставлены? Какие корреляции существуют между чувствительными атрибутами (пол‚ раса‚ возраст) и целевыми переменными или другими признаками?

- Визуализация данных: Помогает нам увидеть паттерны и аномалии‚ которые могут указывать на смещение․ Например‚ карты распределения объектов или текстов‚ сгруппированные по этническим или гендерным признакам․

- Анализ качества данных: Проверяем‚ насколько полно и точно представлены различные группы в наборе данных․ Есть ли пропуски в данных для определенных категорий?

- Тестирование модели на смещения (Bias Testing):

- Контрастное тестирование: Мы подаем на вход модели запросы‚ которые отличаются только по чувствительным атрибутам (например‚ "врач-мужчина" против "врач-женщина") и сравниваем результаты генерации․ Это помогает выявить стереотипные ассоциации․

- Тестирование на крайние случаи (Edge Cases): Проверяем‚ как модель ведет себя с данными‚ которые находятся на периферии обучающего распределения или представляют меньшинства․

- Использование специализированных метрик: Существуют метрики справедливости (Fairness Metrics)‚ которые помогают количественно оценить наличие смещения․ Например‚ равные возможности (Equal Opportunity)‚ равные показатели ошибок (Equalized Odds) для разных групп․

- Человеческая оценка (Human-in-the-Loop): Незаменимый метод․ Эксперты-люди оценивают сгенерированный контент на предмет наличия смещений‚ стереотипов или дискриминации․ Это особенно важно для тонких и контекстно-зависимых видов смещений‚ которые сложно уловить алгоритмически․

- Интерпретируемость модели (Model Interpretability):

- Используем методы‚ которые помогают понять‚ какие части входных данных или какие признаки модель считает наиболее важными при принятии решений или генерации контента; Это может помочь выявить‚ если модель чрезмерно полагается на чувствительные атрибуты․

Наш опыт показывает‚ что комбинация этих подходов дает наиболее полную картину․ Например‚ мы можем использовать статистический анализ для выявления дисбаланса в данных‚ затем применить контрастное тестирование для проверки стереотипов в генерациях‚ и в конце привлечь человеческих экспертов для оценки тонких нюансов‚ которые ИИ пока не может самостоятельно понять․

Как мы боремся со смещениями: Стратегии и методы коррекции

Обнаружить смещение – это только половина дела․ Гораздо сложнее‚ но и важнее‚ эффективно его устранить․ Мы применяем многоуровневый подход к минимизации смещений‚ охватывающий весь цикл разработки и эксплуатации модели․

Эти стратегии можно условно разделить на три категории‚ в зависимости от того‚ на каком этапе они применяются:

Предобработка данных (Pre-processing techniques)

Самый ранний и часто наиболее эффективный способ борьбы со смещениями – это работа с обучающими данными до того‚ как модель начнет учиться․

- Сбалансирование данных:

- Пересамплирование (Oversampling): Мы увеличиваем количество примеров для недопредставленных групп․ Например‚ дублируем изображения людей определенных этнических групп‚ чтобы они были представлены адекватно․

- Недосамплирование (Undersampling): Уменьшаем количество примеров для перепредставленных групп․ Это помогает выровнять баланс‚ но может привести к потере информации․

- Синтетическая генерация данных: Иногда мы используем другие генеративные модели или техники для создания новых‚ реалистичных примеров для меньшинств‚ чтобы увеличить их представленность․

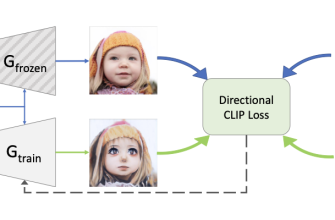

Коррекция в процессе обучения (In-processing techniques)

Эти методы применяются во время обучения самой модели․

- Обучение с учетом справедливости (Fairness-aware training):

- Мы модифицируем функцию потерь (loss function) модели‚ чтобы она не только минимизировала ошибку‚ но и учитывала метрики справедливости․ Это означает‚ что модель будет стремиться к равному качеству предсказаний или генераций для всех групп‚ даже если это немного снизит общую точность․

- Адверсариальное дебиасинг (Adversarial Debias): Используем подход‚ где одна часть модели пытается выявить смещение‚ а другая – его устранить‚ соревнуясь друг с другом․ Это похоже на игру‚ где одна сторона пытается создать предвзятый результат‚ а другая — сделать его непредвзятым․

Постобработка результатов (Post-processing techniques)

Эти методы применяются к выходным данным модели после ее обучения․

- Калибровка и корректировка: Мы можем корректировать выходные данные модели‚ чтобы обеспечить справедливость․ Например‚ если модель систематически занижает вероятность успеха для одной группы‚ мы можем применить калибровочную функцию для коррекции этих результатов․

- Фильтрация и цензурирование: В некоторых случаях‚ если модель генерирует явно предвзятый или оскорбительный контент‚ мы можем использовать дополнительные фильтры или классификаторы для его удаления или изменения․ Однако этот подход требует большой осторожности‚ чтобы не подавить законное выражение или не создать новые формы смещения․

- Человеческий контроль и валидация: Всегда важно иметь "человека в цикле"․ Окончательная проверка сгенерированного контента людьми-экспертами помогает уловить тонкие смещения‚ которые алгоритмы могли пропустить‚ и постоянно улучшать системы дебиасинга․

Мы убеждены‚ что эффективная борьба со смещениями требует не только технических решений‚ но и глубокого понимания этических принципов‚ постоянного мониторинга и готовности к изменениям․ Это не одноразовая задача‚ а непрерывный процесс совершенствования․

Этические аспекты и наша ответственность

Разговор о смещениях в генеративных моделях неизбежно приводит нас к более широким этическим вопросам․ Как создатели и пользователи этих мощных инструментов‚ мы несем огромную ответственность за то‚ как они влияют на мир․ Это не просто вопрос "исправления ошибок"‚ это вопрос построения более справедливого‚ инклюзивного и этичного будущего․

Мы‚ как сообщество‚ должны задавать себе следующие вопросы:

- Прозрачность (Transparency): Насколько мы прозрачны в отношении того‚ как обучаются наши модели‚ какие данные используются и какие смещения они могут содержать? Можем ли мы объяснить‚ почему модель приняла то или иное решение‚ или сгенерировала именно такой контент?

- Подотчетность (Accountability): Кто несет ответственность‚ когда генеративная модель выдает дискриминационный или вредоносный результат? Разработчики‚ компании‚ пользователи? Мы должны создавать четкие механизмы подотчетности․

- Справедливость и равенство (Fairness and Equity): Являются ли наши модели справедливыми для всех групп пользователей? Способствуют ли они равенству возможностей или‚ наоборот‚ усиливают существующее неравенство? Мы должны активно стремиться к созданию моделей‚ которые служат всему обществу‚ а не только его привилегированным частям․

- Приватность (Privacy): Какие данные мы используем для обучения? Насколько они защищены? Могут ли генеративные модели случайно воспроизвести конфиденциальную информацию из своих обучающих данных?

- Вред и его предотвращение (Harm Prevention): Мы должны активно предвидеть и предотвращать потенциальный вред‚ который могут нанести наши модели․ Это включает в себя не только явную дискриминацию‚ но и тонкие формы усиления стереотипов или манипуляций․

Наш блогерский путь научил нас‚ что технологии никогда не бывают нейтральными․ Они всегда отражают ценности тех‚ кто их создает‚ и общества‚ в котором они функционируют․ Поэтому‚ помимо технических решений‚ нам необходимы этические рамки‚ регуляторные нормы и постоянный диалог между разработчиками‚ политиками‚ этиками и обществом․ Мы должны активно участвовать в формировании этих дискуссий‚ чтобы убедиться‚ что ИИ развивается в направлении‚ которое приносит пользу всем․

Взгляд в будущее: К справедливому и этичному ИИ

Несмотря на все сложности‚ мы сохраняем оптимизм․ Проблемы смещения в генеративных моделях – это не приговор‚ а вызов‚ который мы‚ как сообщество‚ способны преодолеть․ Мы видим‚ как растет осознание этой проблемы‚ как появляются новые инструменты и методологии‚ и как все больше исследователей и компаний активно работают над созданием более справедливого ИИ․

Что ждет нас впереди?

- Более совершенные данные: Мы будем стремиться к созданию более разнообразных‚ репрезентативных и высококачественных обучающих данных‚ которые будут отражать все многообразие человечества․ Это потребует значительных усилий и инвестиций․

- Новые алгоритмы дебиасинга: Исследования в области алгоритмов‚ которые способны не только выявлять‚ но и эффективно устранять смещения на разных этапах‚ будут продолжаться и развиваться․

- Стандарты и сертификация: Возможно‚ в будущем появятся общие стандарты и системы сертификации для ИИ-моделей‚ которые будут гарантировать их справедливость и отсутствие смещений․

- Образование и осознанность: Крайне важно повышать уровень осведомленности о проблемах смещения среди разработчиков‚ менеджеров продуктов‚ пользователей и широкой общественности․ Чем больше людей понимают эти риски‚ тем эффективнее мы сможем им противостоять․

- Междисциплинарный подход: Решение проблемы смещения требует сотрудничества не только технических специалистов‚ но и социологов‚ психологов‚ философов‚ юристов и представителей различных культурных групп․

Мы верим‚ что генеративные модели могут стать мощным инструментом для добра‚ для расширения человеческих возможностей и для создания более богатого и разнообразного мира․ Но только если мы будем внимательны к их "слепым пятнам"‚ активно бороться с предубеждениями‚ которые они могут нести‚ и подходить к их разработке с глубоким чувством ответственности и этики․ Наша общая задача – убедиться‚ что зеркало ИИ отражает не только наши прошлые ошибки‚ но и наше стремление к лучшему будущему․

На этом статья заканчиваеться точка․․

Подробнее: LSI Запросы

| Этика ИИ | Алгоритмическая предвзятость | Справедливость в машинном обучении | Дебиасинг данных | Ответственный ИИ |

| Последствия смещения ИИ | Нейтрализация смещений | Генеративные сети и стереотипы | Аудит данных ИИ | Прозрачность алгоритмов |